如何通过学习一个项目,掌握当前NLP的前沿技术?我的答案是transformers。

本篇是我学习transformers的第一篇文章,主要是记录阅读论文:Transformers: State-of-the-Art Natural Language Processing的核心要点。

下载论文请到这里:https://www.aclweb.org/anthology/2020.emnlp-demos.6/

transformers的设计理念

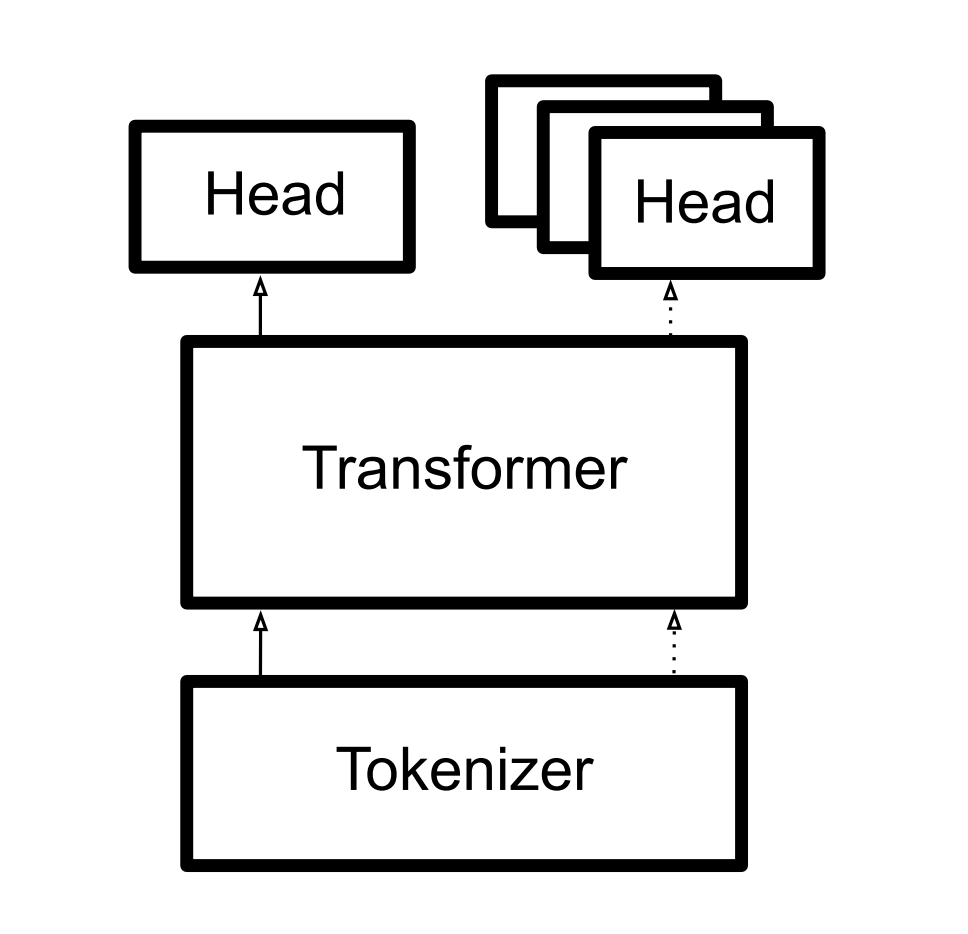

该library中的每个模型都有三个部分组成:

tokenizer 用于将原始的text转为离散的token ids。 transformer将token ids转为包含上下文信息的embeddings head 用transformer得到的embeddings做特定任务的prediction

如下图所示:

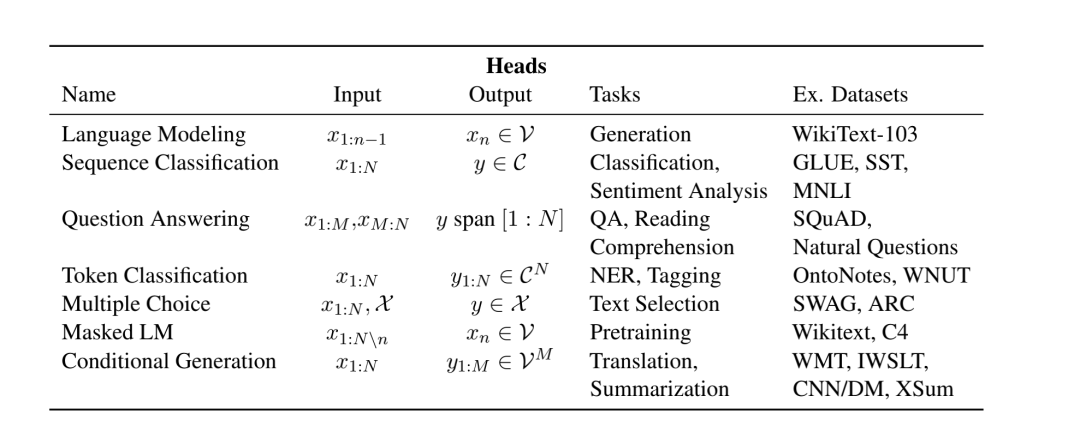

heads的种类

不同的head对应不同的NLP任务。下图中列出7种常用的head。

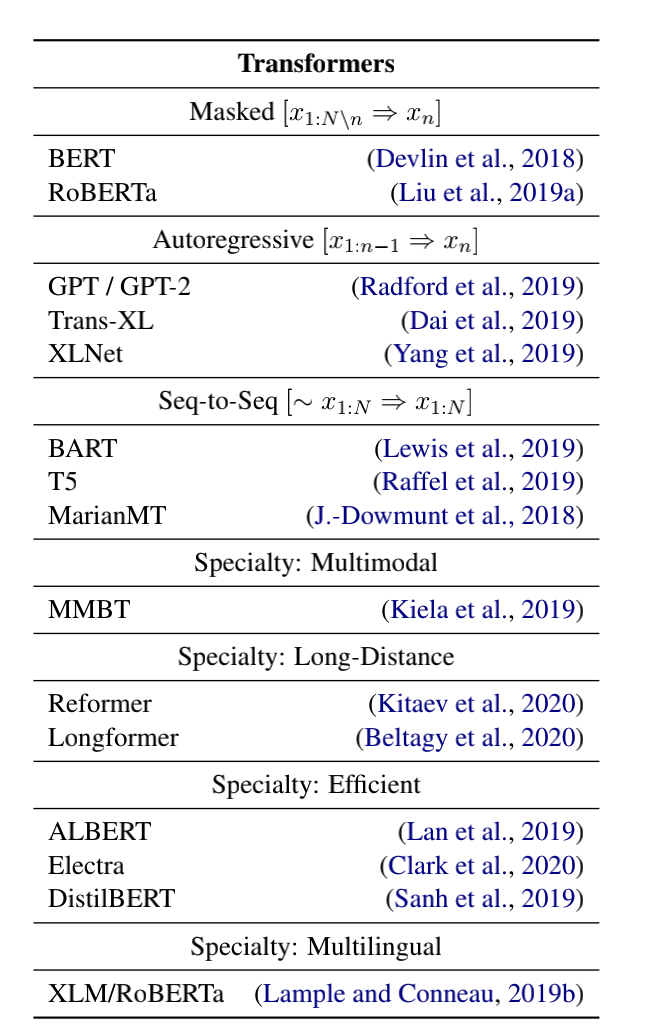

transformer变种的种类

bert以后,各种改进款不断涌现,每种改进款,都着眼于一个方面,有的关注长序列,有的关注计算效率。下图是transformers中实现的不同变种:

下一步

读完这篇论文,对transformers的设计有了整体把握,下面,就是根据自己工作需要阅读不同的部分了。敬请期待。

文章转载自工程师milter,如果涉嫌侵权,请发送邮件至:contact@modb.pro进行举报,并提供相关证据,一经查实,墨天轮将立刻删除相关内容。