一、摘要

分享迪士尼的论文《Affect-Driven Dialog Generation》

二、引入

最近看到迪士尼发的几篇文章,文章[1]研究的是有感情的聊天机器人,文章[2]研究的是如何让聊天机器人和用户维持长期对话关系,文章[3]研究的是如何从文本材料(如小说、对话等)提取角色的本体化描述信息,文章[4]研究的是如何根据文本描述生成动画片。

注意到迪士尼的研究[1]、[2]、[3]的最后一位作者都是一个人Mubbasir Kapadia,他是罗格斯大学(Rutgers University)计算机科学系智能视觉界面实验室(Intelligent Visual interface Lab)主任和助理教授。此前,他是苏黎世迪斯尼研究中心的副研究员。Kapadia的研究处于人工智能、视觉计算和人机交互的交叉领域,其任务是开发智能视觉界面,为具有人类意识的建筑设计、数字故事和严肃游戏提供内容创作的能力。他的简介和实验室可以从[4]的链接获取,我这里把他实验室的几个项目罗列如下:

从[1][2][3]的研究中,我们能看到迪士尼很重视聊天机器人的研究,在这个领域很重视的还有facebook,国内的话腾讯有一些相关的研究,而百度阿里和华为的paper都有其他侧重点。事实上和迪士尼对标的国内互联网媒体企业在新技术上下的功夫还太小,我们的企业不太适应技术驱动的文化。

回到文章[1],迪士尼认为,为问答机器人赋予情绪意味着有以下两个好处:

(1) 避免当系统不理解用户的请求时可能出现的交互问题(例如,引起用户愤怒的不恰当反应)[5]

(2) 与用户建立融洽关系[6]

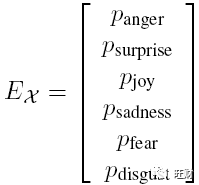

如果要给模型赋予情绪,首先需要对情绪的边界进行限定,这篇文章以1983年Paul Ekman在science期刊的一篇文章中的界定作为自己的标准。事实上,这样干的不止迪士尼一家,Ekman的这篇文章到今天引用已经超过1000了,我们看到的很多模型都是在以下这种表述上对情绪进行定义的:

迪士尼认为,现有的几大模型(seq2seq、attention、CNN)都没有办法直接产生情绪性的输出。事实上这样说太过于绝对,情绪也是一种特征,只要良好建模并施加良好的训练理应是能够建模良好的。但如果要这样做,必须有带有情绪的原始数据才能训练参数,或者如facebook和腾讯一样直接放到线上进行AB测试来训练参数,文中提到用到了三个数据集:

Cornell数据集[8]:有10K的电影角色和220K的对话

OpenSubtitles2018数据集[9]:有3.35G的带翻译的字幕数据集

我们能看出迪士尼找的这两份数据源都是电影对话,而电影对话是有强烈的上下文辅助和环境知识(画面)的,这意味着可以通过标注或情绪学习等手段获取对白的情绪属性,那么就可以进行训练了。

三、正文

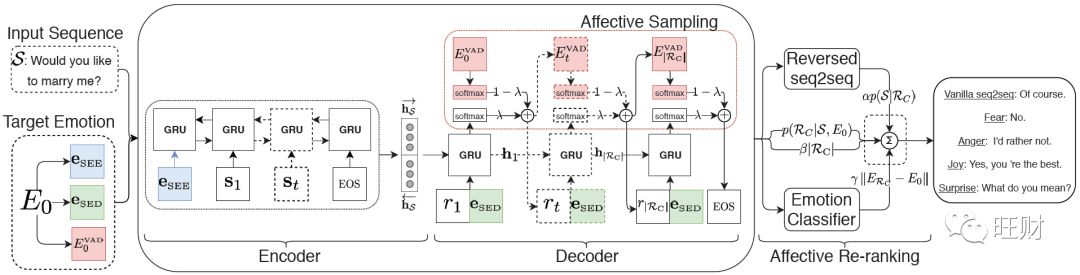

从模型中看出,输入是用户的对白和情绪的三种封装向量,模型主体是一个encoder-decoder结构,编解码器之后输出之前进行的这步re-rank是关键,能够对召回的多种对白按照情绪进行一个编码后输出。

系统分为两个部分:

(1)情感标注——使用情感分类器,根据句子所表达的情感内容自动标注句子,使用VAD词汇值标记单词

(2)情感训练——两个使用编解码器设置的seq2seq网络的训练

下午2点半有课,这个总结先做到这,下次再补充。

四、参考文献

[1] Colombo, P., Witon, W., Modi, A., Kennedy, J., & Kapadia, M. (2019). Affect-Driven Dialog Generation. ArXiv:1904.02793 [Cs]. Retrieved from http://arxiv.org/abs/1904.02793

[2] Chitkara, P., Modi, A., Avvaru, P., Janghorbani, S., & Kapadia, M. (2019). Topic Spotting using Hierarchical Networks with Self Attention. ArXiv:1904.02815 [Cs]. Retrieved from http://arxiv.org/abs/1904.02815

[3] Janghorbani, S., Modi, A., Buhmann, J., & Kapadia, M. (2019). Domain Authoring Assistant for Intelligent Virtual Agents. ArXiv:1904.03266 [Cs]. Retrieved from http://arxiv.org/abs/1904.03266

[4] Zhang, Y., Tsipidi, E., Schriber, S., Kapadia, M., Gross, M., & Modi, A. (2019). Generating Animations from Screenplays. ArXiv:1904.05440 [Cs]. Retrieved from http://arxiv.org/abs/1904.05440

[4] Mubbasir Kapadia, https://www.cs.rutgers.edu/faculty/mubbasir-kapadia, https://ivi.cs.rutgers.edu/

[5] Irina Maslowski, Delphine Lagarde, and Chloe Clavel. 2017. In-the-wild chatbot corpus: from opinion analysis to interaction problem detection. In Proc. of ICNLSP.

[6] Sarah Strohkorb, Chien-Ming Huang, Aditi Ramachandran, and Brian Scassellati. 2016. Establishing sustained, supportive human-robot relationships: Building blocks and open challenges. In AAAI Spring Symposium on Enabling Computing Research in Socially Intelligent Human-Robot Interaction, volume 2123, page 2016.

[7] Paul Ekman, Robert W Levenson, and Wallace V Friesen. 1983. Autonomic nervous system activity distinguishes among emotions. Science, 221(4616):1208–1210.

[8] Cristian Danescu-Niculescu-Mizil and Lillian Lee. 2011. Chameleons in imagined conversations: A new approach to understanding coordination of linguistic style in dialogs. In Proc. of the Workshop on Cognitive Modeling and Computational Linguistics, ACL.

[9] Jorg Tiedemann. 2009. News from OPUS - A collection of multilingual parallel corpora with tools and interfaces. In Recent Advances in Natural Language Processing, volume 5, pages 237–248.