本期将分享近期全球知识图谱相关

行业动态、会议课程、论文推荐

AllegroGraph v8 是一个开创性的神经符号 AI 平台,将大型语言模型 (LLM) 组件直接整合到 SPARQL 中,以及向量生成和向量存储,以实现全面的 AI 知识图谱解决方案。AllegroGraph v8 重新定义了知识图谱的创建方式,并扩展了 AI 在市场上最安全的三元组数据库中实现的目标。

中医药+知识图谱

—--| 会议讲座 |--—

Dagstuhl Seminar——Are Knowledge Graphs Ready for the Real World? Challenges and Perspective

研讨会将在2024年2月4日 - 2024年2月9日于德国瓦德恩达格施图尔城堡举行。

https://www.dagstuhl.de/24061

Graph Sparsification

本周推荐的是发表于VLDB 2023的综述:Demystifying Graph Sparsification Algorithms in Graph Properties Preservation,该文对图稀疏化算法进行综述,作者来自密歇根大学。

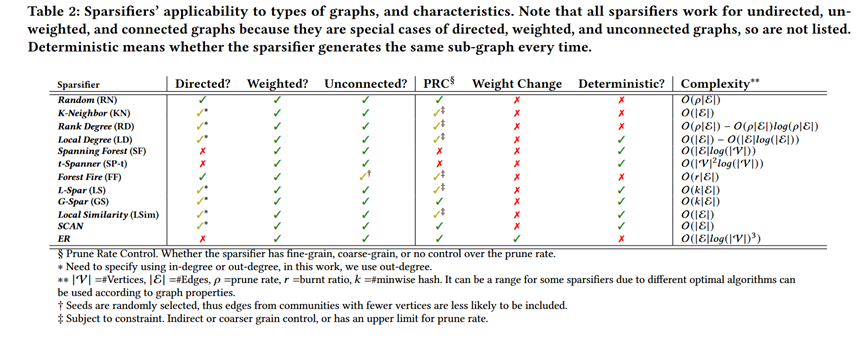

图稀疏化(Graph Sparsification)通过顶点和/或边的子集的稀疏图来近似给定图。有效的稀疏化算法的目标是保持与下游任务相关的特定图属性,同时最小化图的大小。由于不规则性和大的真实世界图尺寸,图算法经常需要较长的执行时间。通过用更小的稀疏化图替换完整图,可以大大减少图算法的运行时间,而不会显著降低输出质量。然而,众多稀疏化器(sparsifiers)和图属性之间的相互作用并没有得到广泛的探索,图稀疏化的潜力也没有得到充分的理解。该文涵盖了16个广泛使用的图度量、12个代表性的图稀疏化算法和14个跨各种类别的真实世界数据图。该文综述的sparsifiers如下表所示。

该文提出了一个框架来针对图度量评估稀疏化算法的性能,并进行了全面的实验研究,评估稀疏化算法在保持图度量方面的性能。该论文链接https://www.vldb.org/pvldb/vol17/p427-chen.pdf,代码链接https://github.com/yuhanchan/sparsification,感兴趣的读者可以关注。

更多链接

内容:林丁洋、袁知秋、唐静、王图图

诚邀您加入我们的gStore社区,我们将在群内解决使用问题,分享最新成果~

请在微信公众号图谱学苑发送“社区”入群

欢迎关注北京大学王选计算机研究所数据管理实验室微信公众号“图谱学苑“

实验室官网:https://mod.wict.pku.edu.cn/

微信社区群:请回复“社区”获取

gStore官网:http://www.gstore.cn/

GitHub:https://github.com/pkumod/gStore

Gitee:https://gitee.com/PKUMOD/gStore