问题引入

面试中问到随机森林模型都会说到模型的泛化能力比较好,但是为什么比较好呢,笔者在面美团的时候被问到,当时说的是因为随机森林的采样在样本随机性以及特征随机性上的随机保证了泛化能力,但是这样为啥就能保证泛化力好呢?能否有啥理论上的推导了,这.....我还真的一脸懵比~~~

问题解答

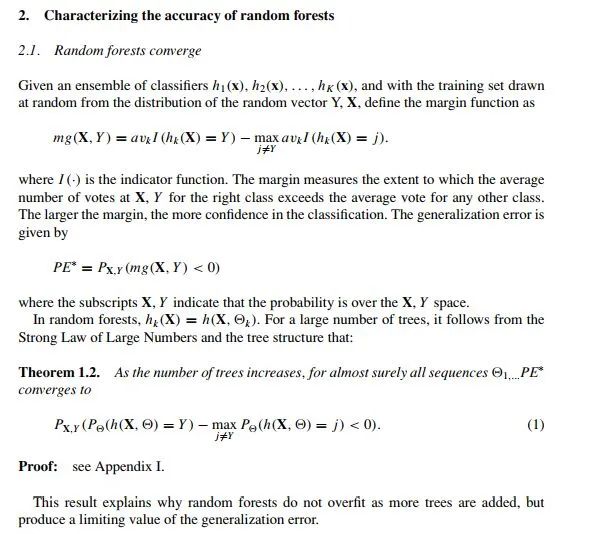

在BREIMAN于2001年的文章[1]中有提到过,随着决策树目的增加,随机森林会收敛到一个极限误差值 [This result explains why random forests do not overfit as more trees are added, but produce a limiting value of the generalization error.] 论文在这里,论文的末尾有证明。

直接解释一下,省的自己还得看论文,对此我在国内看了一篇文章【2】中介绍的是,随机森林的泛化误差界与单个决策树的分类强度成负相关,与决策树之间的相关性成正相关,分类强度越大且相关性越小,泛化误差界越小,可以看到随机森林中的随机性可以保证越小,如果每棵树的越大的话,泛化误差会收敛到一个small界,这个界当然越小越好,就是泛化误差越小。

知乎上也有一些人在讨论,可以看看下文中的链接。

参考:

Breiman L. Random forests[J]. Machine learning, 2001, 45(1): 5-32.

董师师, 黄哲学. 随机森林理论浅析[J]. 集成技术, 2013 (1)

https://www.zhihu.com/question/30295075

文章转载自百面机器学习,如果涉嫌侵权,请发送邮件至:contact@modb.pro进行举报,并提供相关证据,一经查实,墨天轮将立刻删除相关内容。