01

介绍

近年来,大型语言模型(LLMs)在结构化环境(SEs)中的推理能力引起了广泛关注。针对大规模语言模型在结构化环境中推理的问题,现有研究通常采用两种主流方法:逐步推理和微调模型。

逐步推理方法通过逐步扩展推理路径与SEs交互,每一步都需调用LLM。这种方式能够缓解幻觉问题,但效率较低。例如,要回答“奥巴马的女儿是谁”这样的问题,逐步推理需要调用 LLM 至少两次——首先查询“奥巴马”的相关关系,然后从候选关系中选择“父亲”。

微调模型方法则通过使用标注数据训练模型,帮助其记忆环境并直接生成推理路径,虽然效率较高,但其输出结果无法保证能够在SEs上被验证。此外,微调方法依赖大量标注数据,在大规模SEs中,标注成本高昂且难以获取。

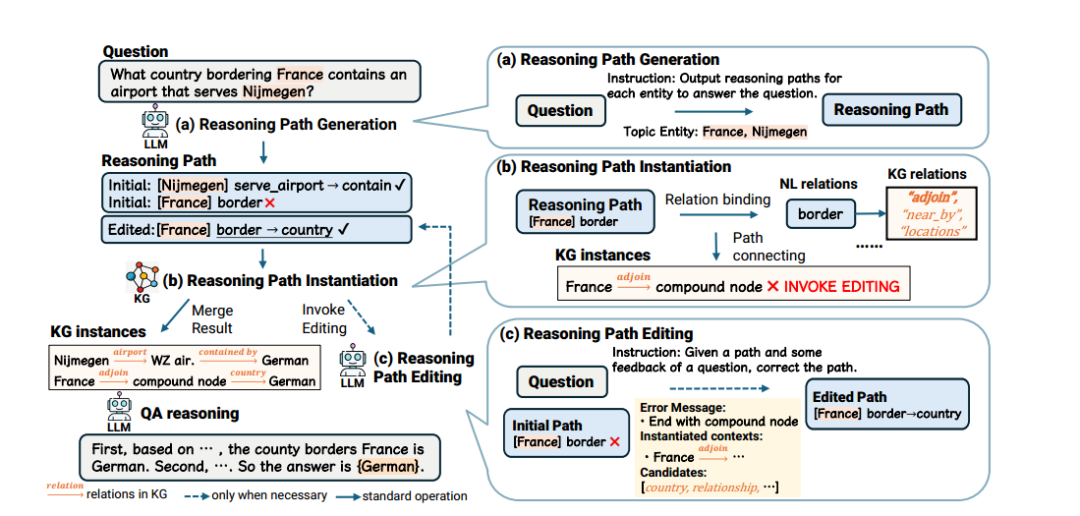

为了解决上述问题,本文提出了 Reasoning-PathEditing (Readi) 框架,该方法充分利用了LLMs的内在规划能力,并结合动态反馈机制,实现高效且可靠的推理。

02

方法

1. 推理路径生成

输入问题 (Q) 和主题实体 (n) 个。 使用思维链(Chain of Thought, CoT)的方式生成推理路径 (P),包含从每个主题实体出发的 (n) 个约束条件。

从“France”出发,约束为“邻接的国家”; 从“Nijmegen”出发,约束为“服务该城市的机场”及“包含这些机场的国家”。

2. 推理路径实例化

关系绑定:

将路径中的NL关系与KG中的关系模式绑定。

使用BM25和Contriever从KG中检索出与NL关系语义相似的关系模式作为候选关系。

示例:将“border”绑定为“adjoin, near_by, locations”等候选关系。

路径连接:

确定起始实体后,从KG中寻找符合候选关系序列的路径实例。

若某个候选关系能够连接到当前实体,则实例化该关系;重复该过程,直至实例化完整路径。

示例:对于图中的示例,首先需要检查KG中是否存在任何从“France”出发的路径实例,其中的关系依次匹配(P)中所有关系的绑定候选关系。具体而言,如果候选“adjoin, near_by, locations”中的任何关系连接到“France”(橙色粗体“adjoin”),将获得满足约束“[France] border”的实体,因此NL关系“border”在KG上实例化为“adjoin”。然后,对(P)中剩余的关系重复相同的过程,最终实例化整个路径

实例化失败:

如果某段路径无法实例化,例如没有候选关系能连接当前实体,则需要触发路径修订。

Reasoning Path Editing

错误摘要:

分类错误类型,定位错误位置和相关信息:

不相关NL关系:当前NL关系的候选KG关系均无法连接当前实体;

空路径:推理路径不存在;

路径以复合节点结束:实例化路径的最后一个节点是复合节点。

如果实例化出错,检测错误位置、相关NL关系及当前结束的实体

错误准备:

收集修订所需信息:

错误原因;

部分完成的实例路径; 当前结束节点附近的KG关系作为修订候选。 路径修订: 调用LLM基于问题 (Q) 和错误信息生成修订后的路径。

路径以复合节点结束

部分完成的路径“France Compound Node”; 修订候选关系“country”和“relationship”。

4. 基于知识图谱的问答

将每个路径(约束)实例的交集作为KG实例集合

结合问题 (Q) 和

对与图片中的样例,其KG实例路径包含: ((France, adjoin, Compound Node)) ((Compound Node, country, German))。 根据这些三元组推理得出: “邻接法国的国家是‘German’”。

03

总结