论文链接:https://arxiv.org/pdf/2308.09687

代码地址:https://github.com/spcl/graph-of-thoughts

01

论文概述

02

论文核心

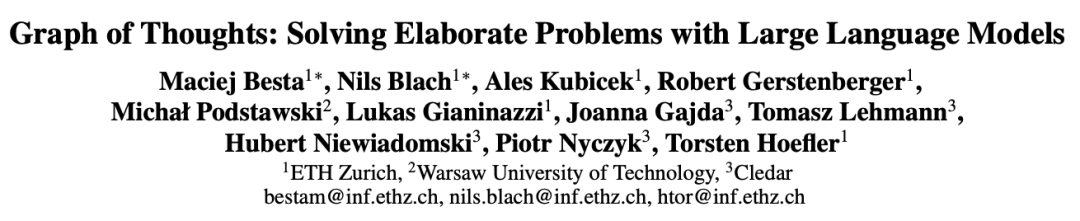

输入到输出提示 (Input-Output, IO):输入序列后,直接用语言模型获取输出,不添加任何中间思考过程。

思维链(Chain-of-Thought, CoT):在输入和输出之间引入多个中间思维状态,相比IO方法,可以显著提升语言模型在数学难题和通用推理任务上的性能。

多思维链(Multiple CoTs):独立生成多条思维链,然后根据预先指定的评分指标返回最佳输出结果的思维链。

思维树(Tree of Thoughts, ToT):ToT将过程或推理建模为一棵思维树来增强CoT-SC方法,单个树节点代表部分解决方案;基于给定的节点,思维生成器(thought generator)可以构造出一定数量的新节点,然后用状态评估器(state evaluator)为每个新节点生成相应评分。

03

思维图 (GOT) 框架

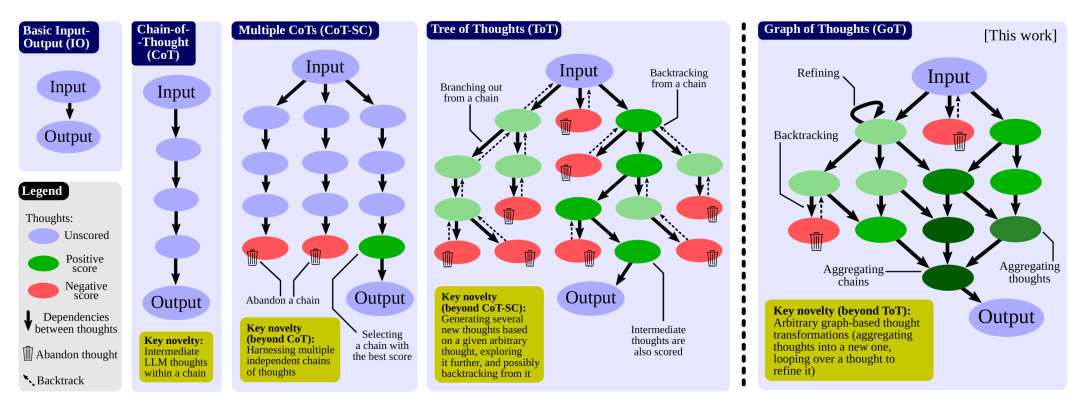

提示器(Prompter):为LLM准备信息,主要负责把图结构编码进提示词中,GoT架构允许用户根据不同用例实现不同的图编码,提供全部图结构访问权限。

解析器(Parser):从LLM的回复中抽取信息,解析器为每个思维构造出一个思维状态(thought state),包含了抽取出的信息,并用于后续状态更新。

评分模块(Scoring):对LLM回复进行验证和评分,验证一个给定的LLM思维是否能够满足潜在的正确性条件,然后对思维进行打分。

控制器(Controller):协调整个推理过程,并决定如何继续推理,控制器中包含两个重要组件:图操作(the Graph of Operations, GoO)和图推理状态(GRS)。其中GoO是一个静态结构,指定了给定任务上的图分解过程,即规定了可用于LLM思维转换的操作,以及思维之间的顺序和依赖关系;每个操作对象都知道自己的前置操作和后继操作。GRS是一个动态结构,用来维护LLM推理过程进行中的状态,包括所有思维的历史及状态。

04

论文实验

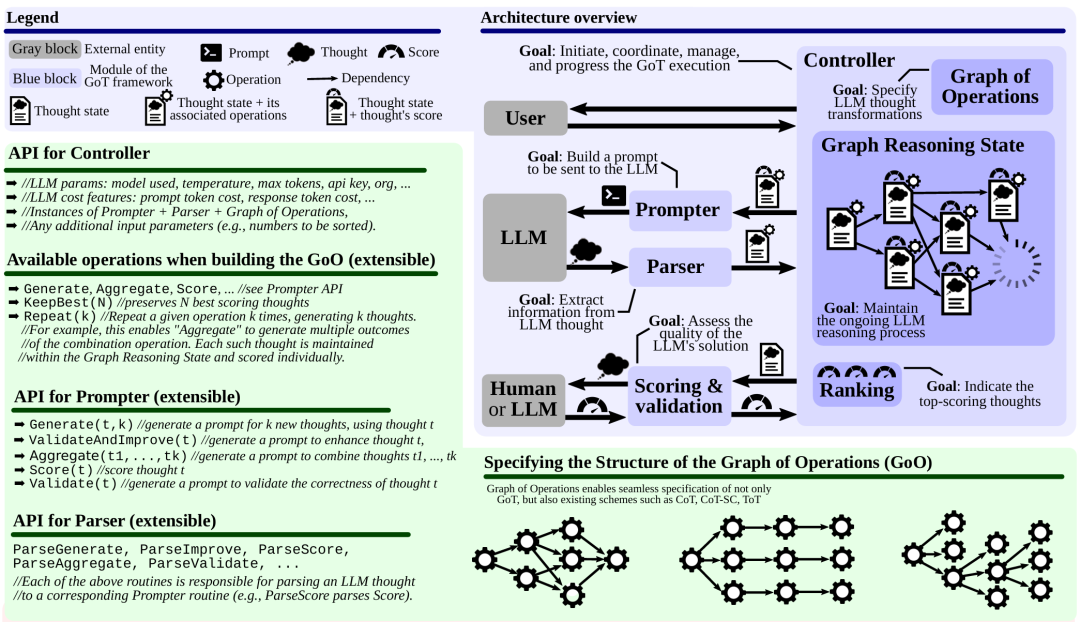

与现有技术相比,在对排序任务进行评估时,可以发现与 CoT 、具有自洽性的 CoT 或 ToT 提示等技术相比,GoT 提示始终产生更少的错误。

05

论文总结

提示工程是大型语言模型(LLM)研究的中心新领域之一。它使得能够高效地使用LLM,无需任何模型更新。然而,设计有效的提示是一项具有挑战性的任务。人类的任务解决通常是非线性的,它涉及将中间解决方案合并为最终解决方案,或在发现新见解时改变推理的流程。在这项工作中,提出了“思维图”(GoT),使LLM能够有效地解决不同的任务,而无需任何模型更新。其关键的想法是将LLM推理建模为一个任意图,其中思维是顶点,思维之间的依赖关系是边。这使得能够进行新的思维转换,如聚合。并且和现有提示方案相比,如ToT,图提示的排序质量和成本都是最优的。