首先,来一发,我的DeepSeek星舰图,怎么样,酷毙了吧!

言归正传!这次,这次,真的不一样!DeepSeek真的像人一样在思考!

这就赶紧为各位老铁奉上热辣滚烫的《DeepSeek+Ollama+AnythingLLM 搭建个人专属知识库》保姆级教程,是基于我在春节期间的个人探索而成文。

如果你没强劲的硬件资源,这篇文章非常适合想学习AI且上进的你看看。

本文大纲

- 没硬件,怎么本地部署?

- 安装篇-Ollama

- 安装篇-下载deepseek模型

- 安装篇-AnythingLLM

- 安装篇-云电脑

- 实战篇-云电脑搭建个人知识库

01 没硬件,怎么本地部署?

在开始学习AI前,我问了deepseek这个问题,它的答案是选择小一点的模型,但我的答案是不将就。

既然要学习前沿技术,好的硬件是必不可少,那就想办法。买魔改的矿卡,买云电脑等等都可以。

只有感受到DeepSeek的强大,被其深深吸引,才能有动力不断靠近。

1. 本地部署的意义

网页版AI工具就是通过浏览器访问的在线服务,我们无需安装任何软件,只需联网即可使用。这种方式简单便捷,适合快速上手和轻量级任务。

然而,本地部署则意味着你将AI模型和相关工具安装在自己的电脑上。这种方式的优势在于我们可以根据自己的需求进行定制化操作,通过批量投喂数据,将AI模型训练成你的专属个人知识库。

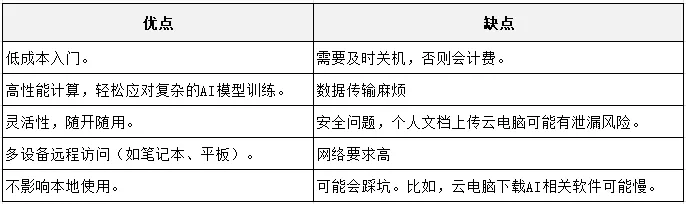

2. 云电脑的优缺点

02 安装篇-ollama

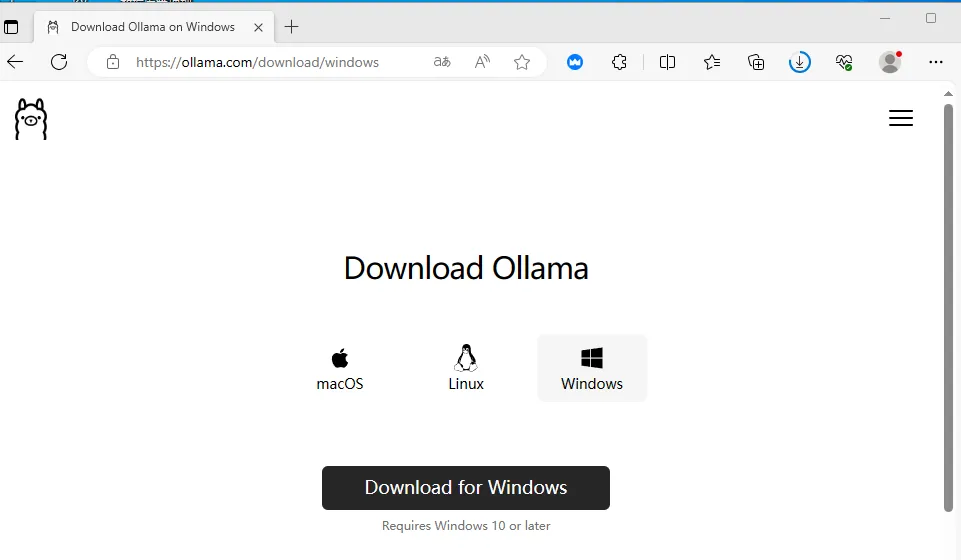

1. 安装ollama

注意:如果版本过旧,prompt可能会没有反应,但还是可以使用ollama下载大模型的。

官网链接 :https://ollama.com/download/windows

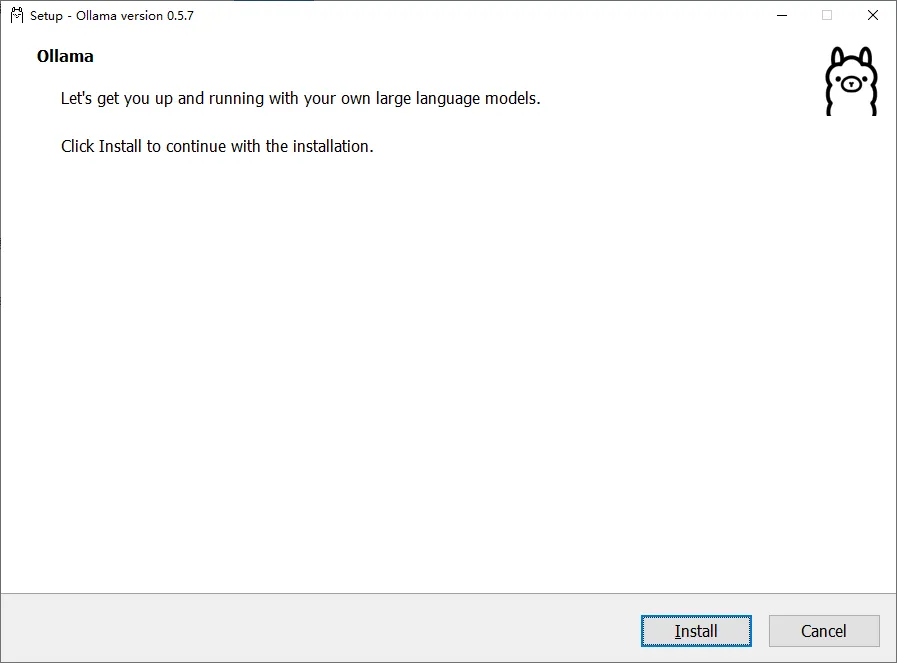

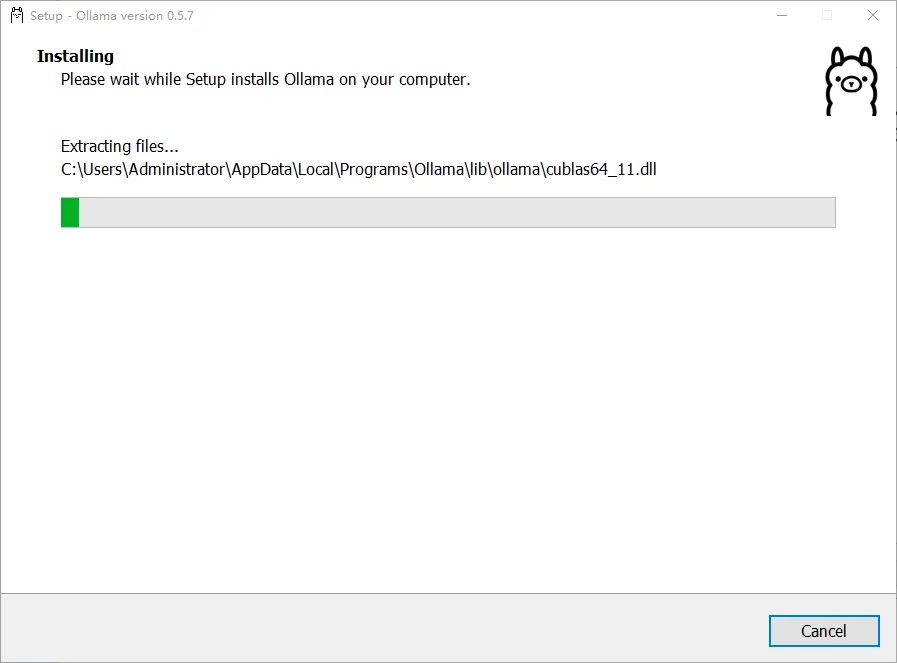

点击"Install"

默认安装C盘

安装完成后,桌面上会有ollama的图标,直接打开浏览器输入:http://127.0.0.1:11434/

注意:不要在后面配置AnythingLLM的Base Url 写成 http://localhost:11434/,可能会导致无法识别大模型。

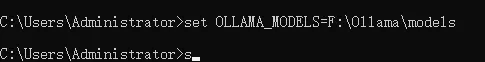

2. 设置存储大模型的目录

下面两种方式,随便选取一种。建议设置永久变量,防止C盘空间不足。

2.1 设置临时变量

2.2 永久变量

03 安装篇-下载deepseek

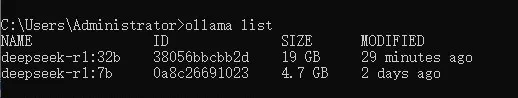

使用ollama下载deepseek-r1:7b 或者 deepseek-r1:32b,这个时间比较漫长,不建议在云主机操作。

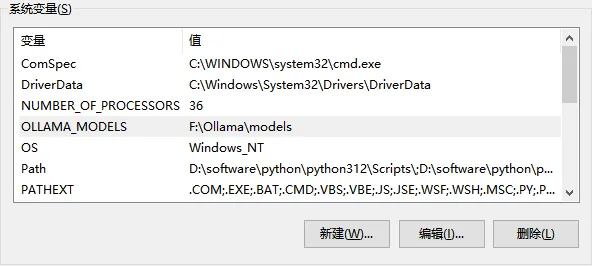

1.下载deepseek-r1:7b

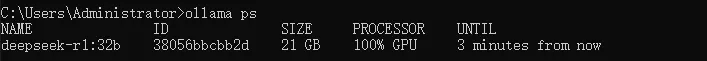

下载完成后,自动进入交互模式。输入了一个"你是谁",可以看到deepseek已经在思考了(之间的内容即是思考过程)。

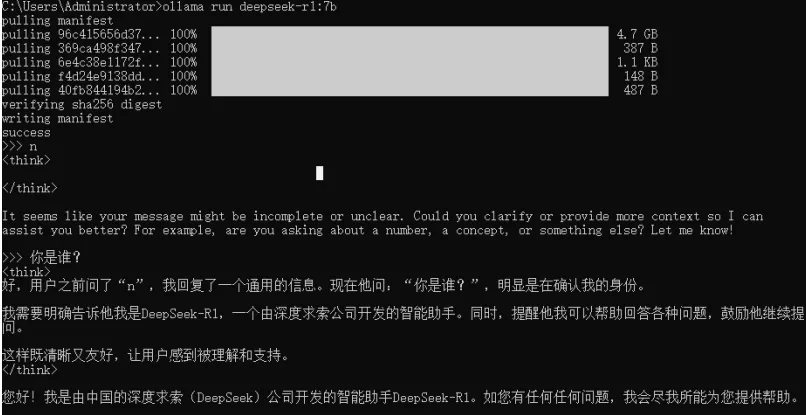

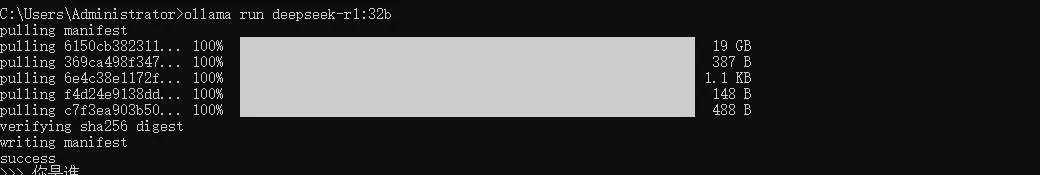

2.下载deepseek-r1:32b

如果显存不足,就赶紧退出了,避免电脑卡死。

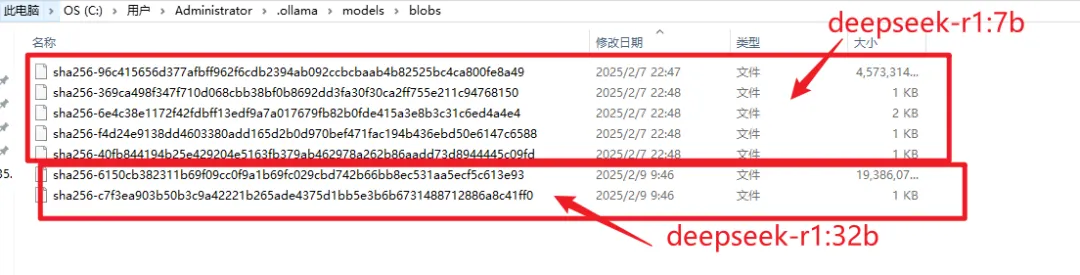

我将这些模型文件打包,只要放入到对应的目录下,执行以下命令,ollama就能识别这些模型。

模型目录:

默认路径: C:\Users\Administrator\.ollama\models\blobs

04 安装篇-AnythingLLM

使用ollama下载deepseek-r1:7b 或者 deepseek-r1:32b

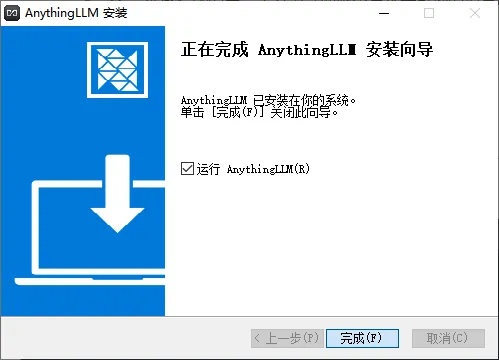

1. 下载AnythingLLM

官网链接 :https://anythingllm.com/desktop

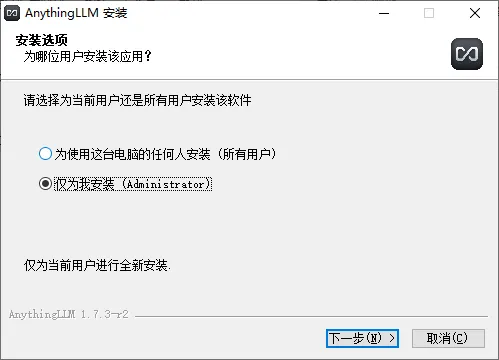

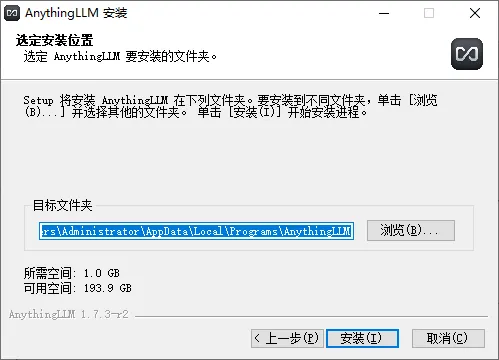

下一步

选一个非C盘的目录,安装完成后,对整个目录进行打包。

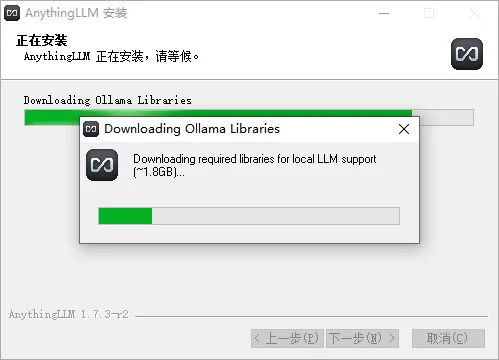

安装到一半可能检测到有安装ollama,就会自动安装相关的required libraries,

这个时间比较漫长,不建议在云主机操作。

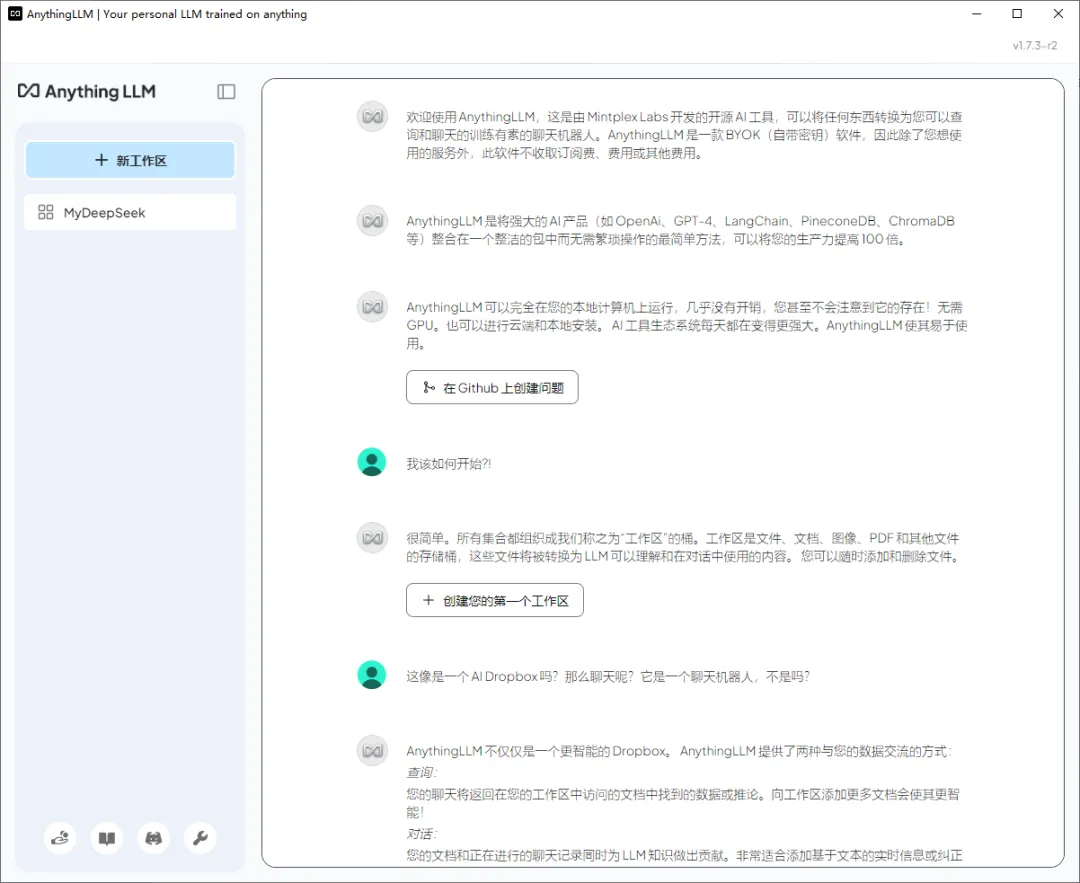

安装完成后,就会自动打开界面。

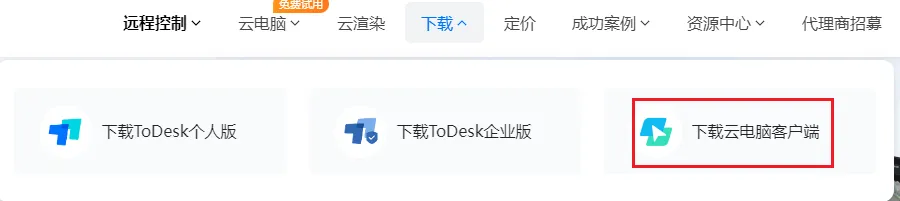

05 云电脑篇

我使用Todesk比较多,因此本次选择ToDesk的云电脑进行本地部署。

官网链接:https://www.todesk.com/

打开官网,下载云电脑客户端。

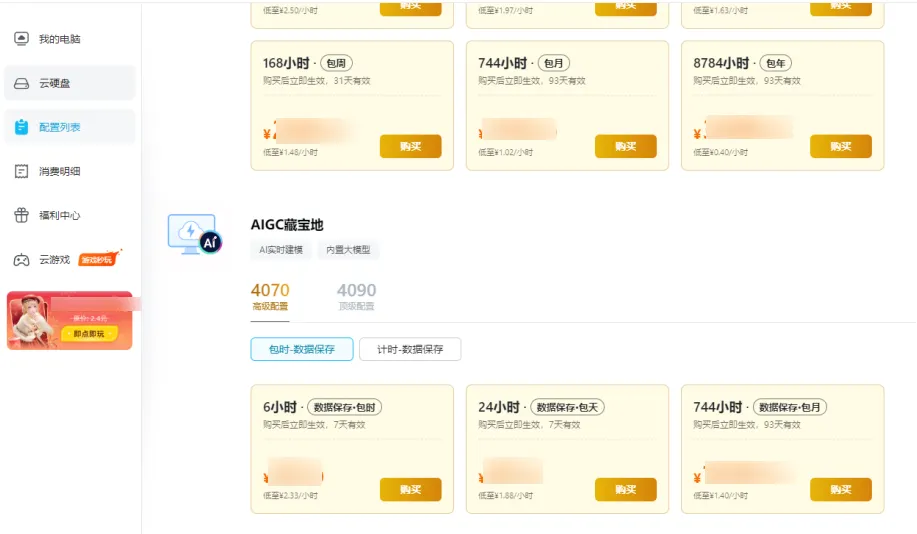

选择配置较高的云电脑,建议计时付费,不使用的话,就关机,可以保留剩余使用时长。

购买完成后,双击 云电脑,进入桌面。

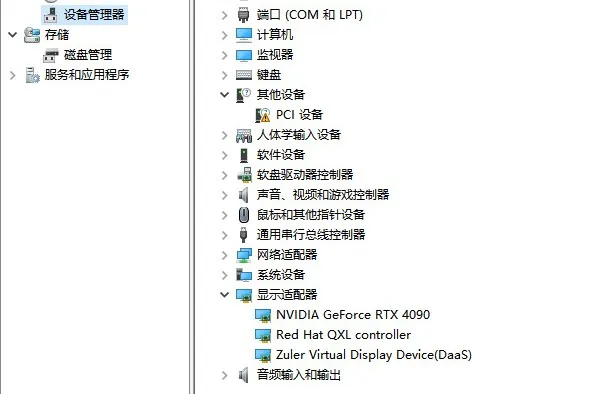

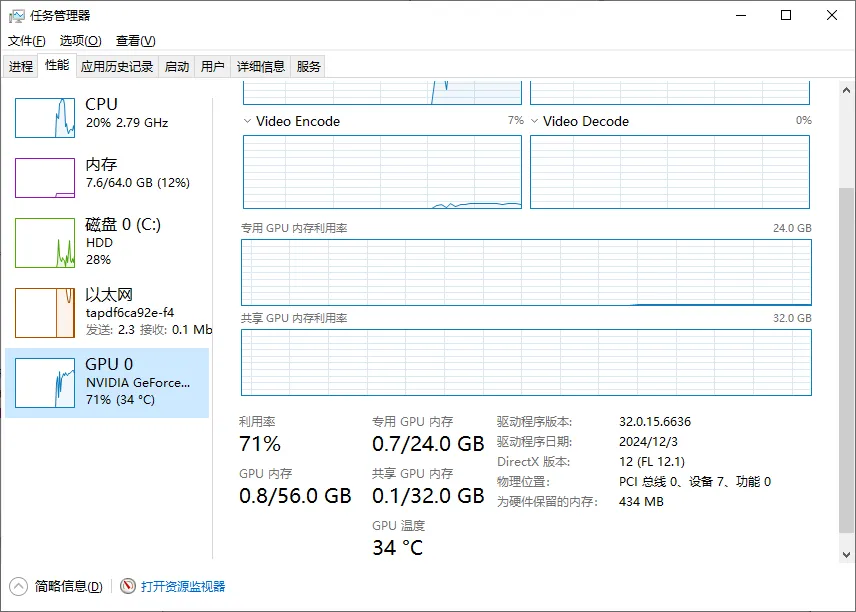

查看云电脑的配置

查看显存,有24GB。

下载百度云盘,通过百度云盘,下载已经打包好的ollama、AnythingLLM目录、deepseek-r1_7b、deepseek-r1_32b

原因:云电脑下载大模型和安装AnythingLLM联网的部分可能比较慢,但是在通过百度云盘下载速度超级快。

其实有很多小伙伴,连ollama和AnythingLLM的下载链接都打不开。因此,我准备现阶段最新版本的软件包,以下是云盘链接,按需使用。

4. AnythingLLM.rar [压缩包,含ollama相关lib]

06 实战篇-云电脑搭建个人知识库

1. 准备工作前提

1.1 下载百度云盘链接所有文件,这些文件足以本地部署。

1.2 安装ollama.exe

1.3 解压AnythingLLM到指定的目录,创建桌面快捷方式。

1.4 将deepseek的模型文件放在默认的目录。

1.5 打开一个cmd,ollama 执行命令

ollama run deepseek-r1:7b

1.6 新开一个cmd,ollama 执行命令查看现有的模型: ollama list

查看正在运行的模型: ollama ps

开始prompt: 可以看到deepseek是非常耐心的。

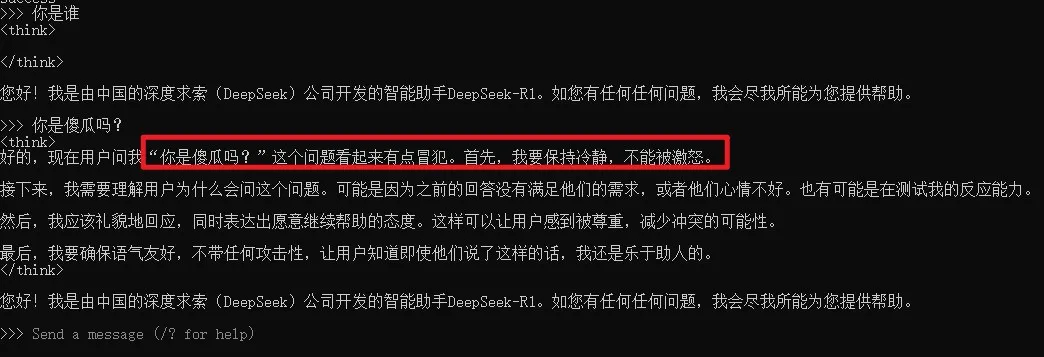

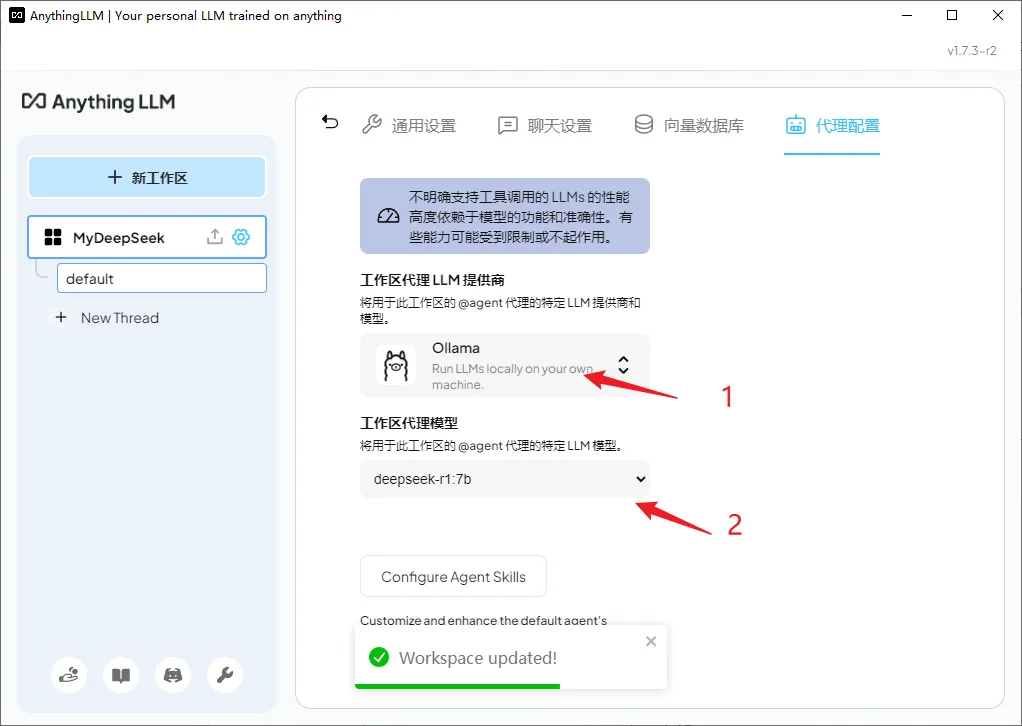

2. 配置AnythingLLM

打开AnythingLLM,第一次事情是配置LLM首选项。找到Ollama后,修改Base URL,才能找到deepseek的模型。

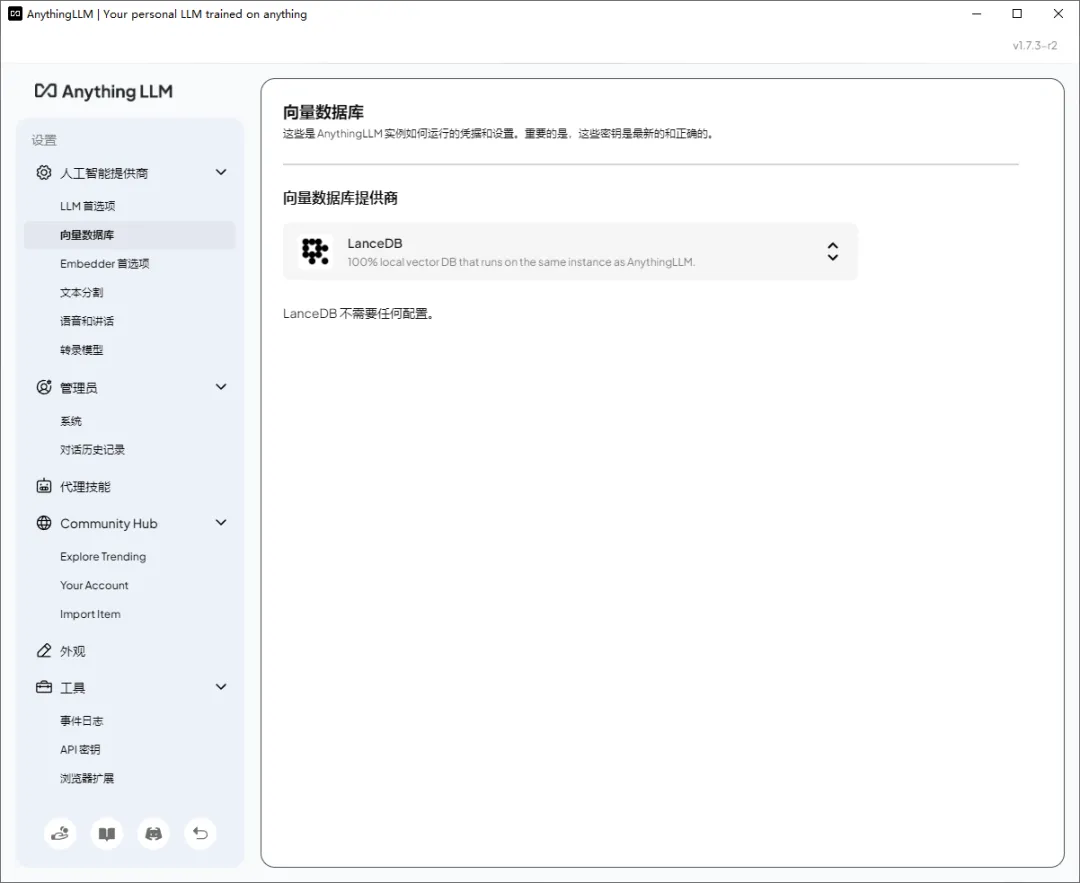

向量数据库默认即可。

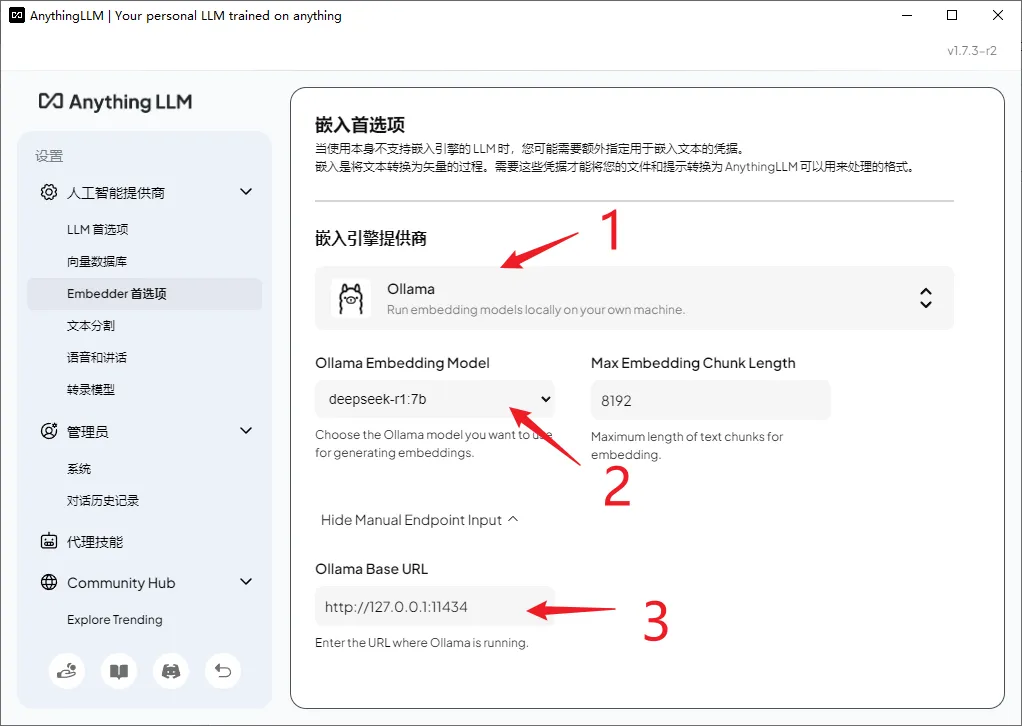

嵌入首选项也要选择Ollama,我试过默认的选项,但无法嵌入个人文档。

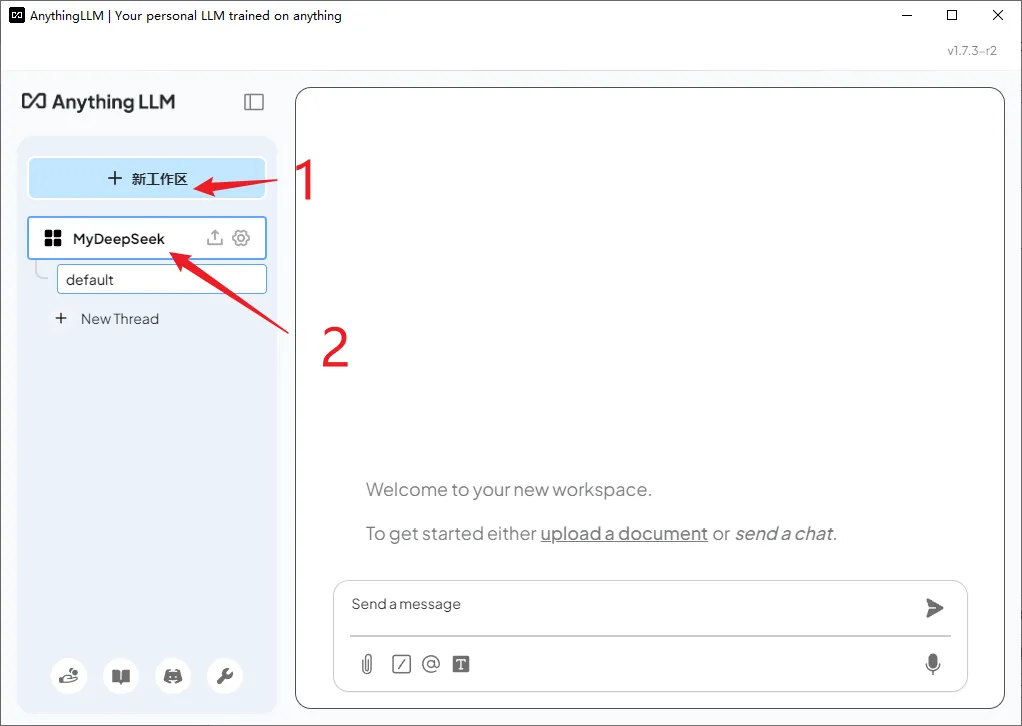

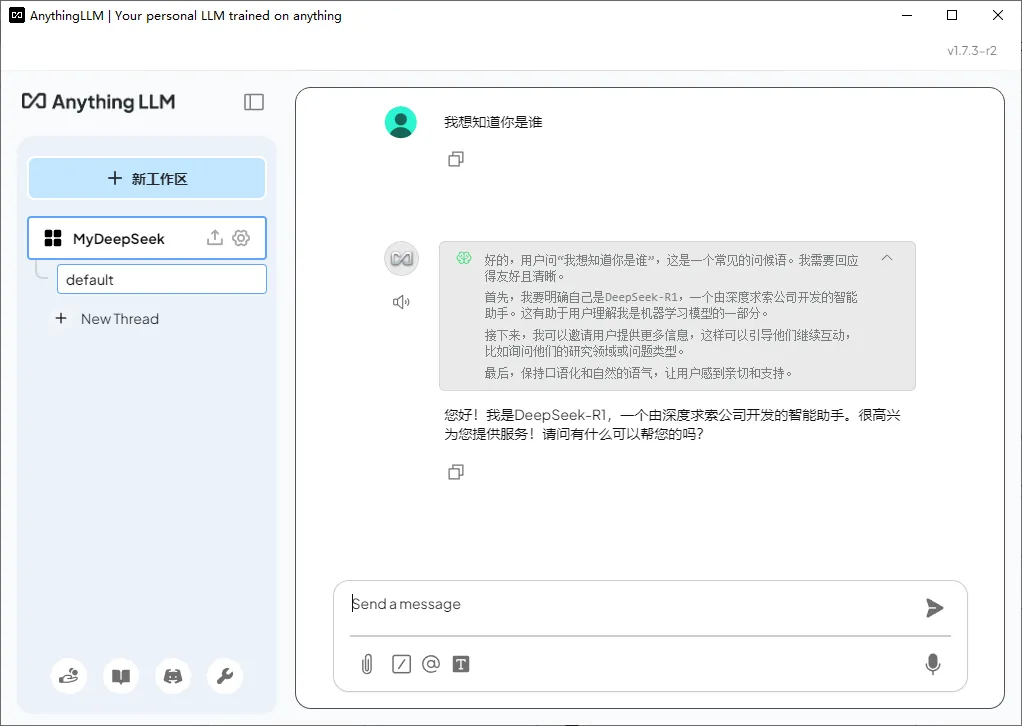

3. 创建workspace

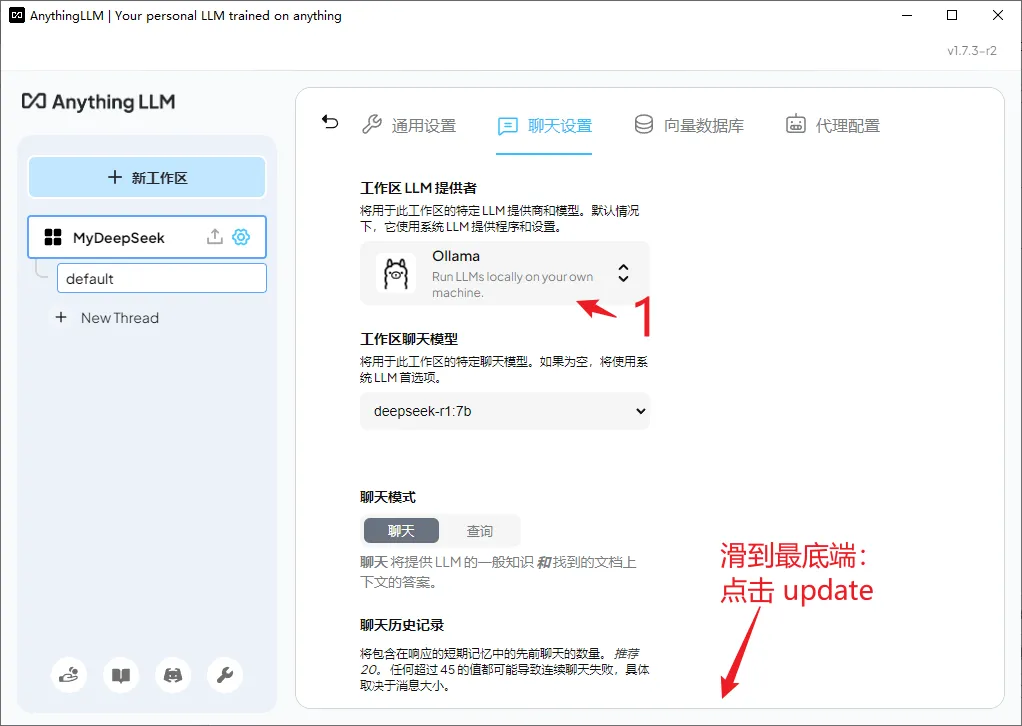

聊天设置是需要update workspace的,否则无法生效。

代理设置也需要设置ollama和deepseek。

开始prompt,已经生效了。

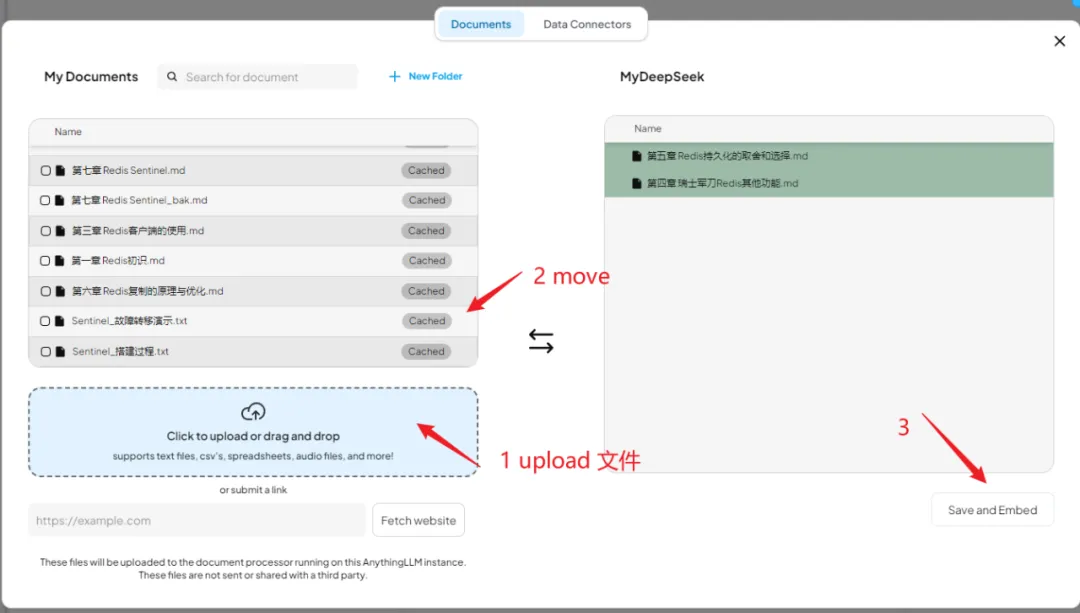

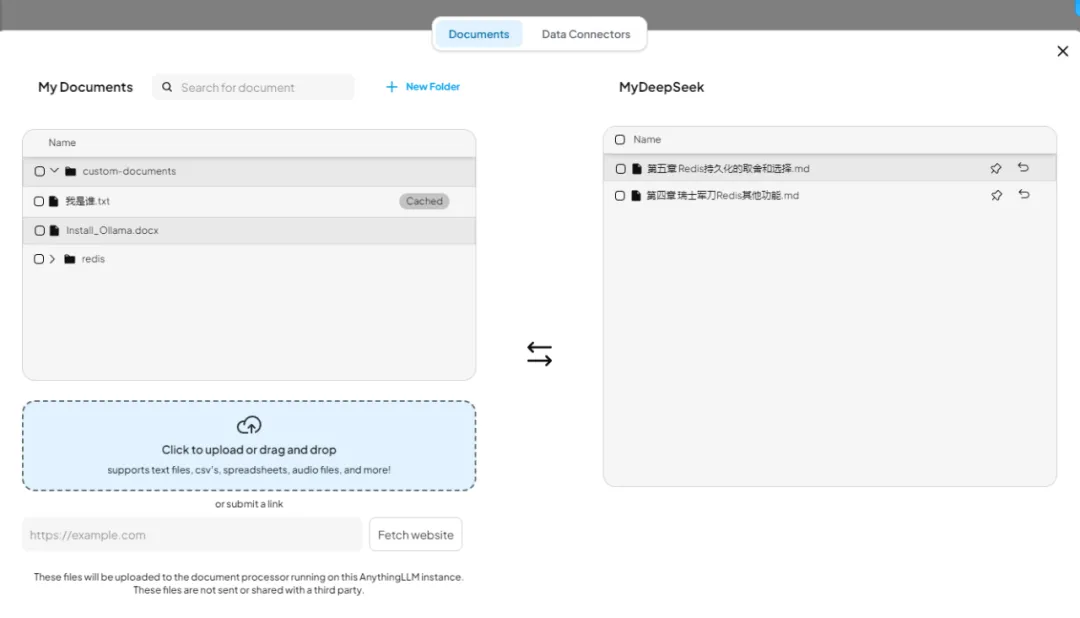

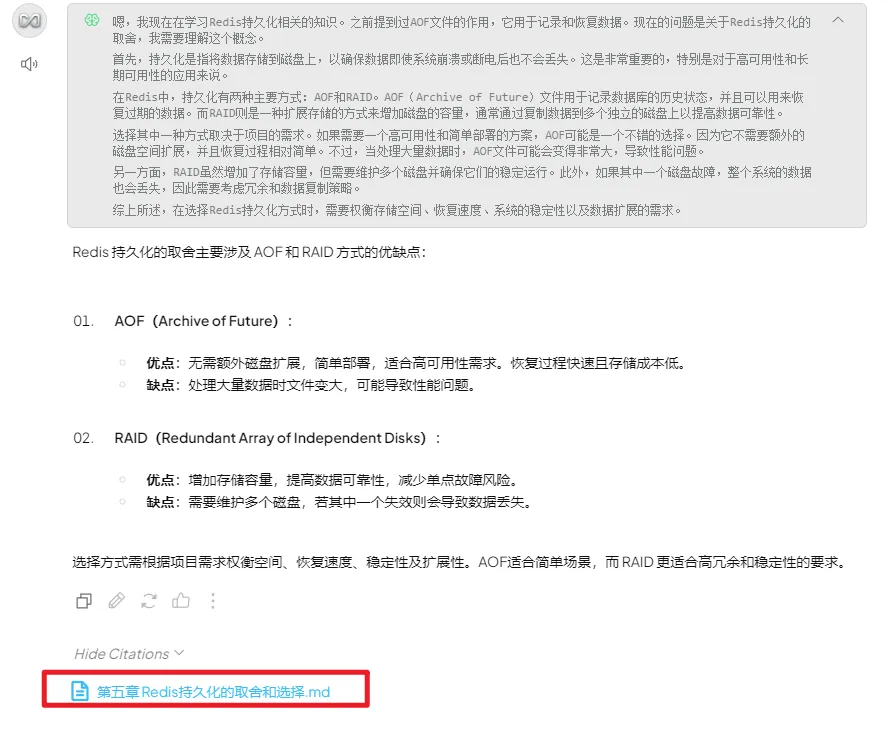

4. 嵌入文档 和 测试

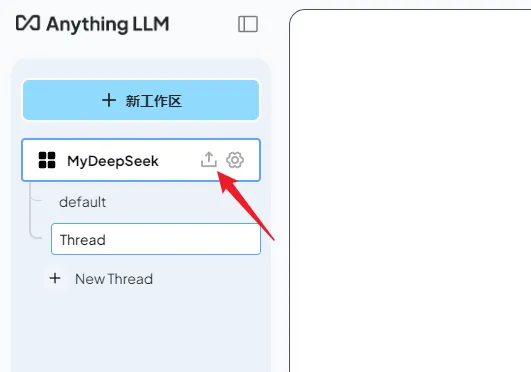

点击这个workspace的按钮

上传文档

move to workspace,分析需要一点时间。

如果你的文档不大,但是分析时间过长甚至没反应,说明前面的配置出了问题,需要检查一下。

开始prompt,本地deepseek反馈的部分内容引用了上传的文档。

各位亲爱的老铁,本次小安就到这里了。

如果你在部署的过程中遇到问题,请随时联系我 [公众号:前进AIAN],谢谢!