点击下方卡片,关注“慢慢学AIGC”

前言

加入我们的竞赛,时间持续到 6 月 17 日,利用 NVIDIA 和 LangChain 技术,展示您使用前沿生成式 AI 驱动应用的创新。为了帮助您入门,我们探讨了一些应用示例来启发您的创意之旅,同时分享一些技巧和最佳实践来帮助您在开发过程中取得成功。

激发您的创造力

生成式 AI 代理有许多不同的实际应用。根据应用的隐私、安全和计算要求,在之前的竞赛中开发的代理或协同应用程序使用大型语言模型(LLM)或小型语言模型(SLM)。这些例子包括:

使用本地托管的 LLM 模型,为 Outlook 设计的插件可帮助用户撰写电子邮件、总结电子邮件主题并回答收件箱问题。

采用命令行助手来增强命令行界面,将普通英语指令翻译成可执行的命令行提示。

一种视觉探索工具,可分析图像并提供直观的照片分析功能。

开发人员可以在游戏、医疗保健、媒体和娱乐等领域创建内容生成应用程序。其他选项包括总结、问答、情感分析和实时翻译。在医疗保健领域,代理可以通过分析患者症状、病史和临床数据来帮助诊断疾病。

这些想法中有许多可适应您的数据和您要解决的问题 - 无论是使用代理来改善您每周的杂货购物,还是在商业环境中优化客户服务响应。

开发之旅的快速技巧

由 LLM 或 SLM 驱动的应用程序开发涉及集成多个组件。该过程包括准备数据、选择合适的基础模型、微调所选基础模型,以及为各种下游任务编排模型。这些任务可能包括代理创建、推理服务和其他专门功能。

让我们通过创建基于 LLM 的代理应用程序的场景来了解一下。在代理应用程序中选择合适的基础模型至关重要,因为它在准确高效地理解用户查询方面发挥着关键作用。这个决定引发了一些重要问题,比如是选择 LLM 还是 SLM,是否量化模型。这些问题的答案并非言简意赅,受应用程序需求、部署基础架构、所需推理速度和准确性要求等因素的影响。

以下几点是需要谨记的:

如果您的应用程序部署在显存较小的 GPU 上,您应考虑使用量化模型或在使用前量化现有模型。开发人员可以使用量化框架等工具,如模型优化器,以及各种插件,包括 NVIDIA TensorRT for Large Language Model (TensorRT-LLM),这些插件可在 LangChain 框架中使用。

如果推理精度很重要,您应该使用与其用例相符的基础模型,但其中一些模型需要大显存 GPU。

如果您的目标是在应用程序中使用 retrieval-augmented generation (RAG),那么格式化和编纂您的文档就是应用程序开发的一个重要方面。您可以利用 NVIDIA NeMo Curator 或支持处理不同文档模式的文档加载器等工具,并查阅我们最近关于 NeMo Curator 的博客文章以获得更多见解。这些只是帮助您入门的几个主题。

对于诸如微调和构建多代理应用程序等更高级用例,您可以探索 NeMo 框架和 LangGraph。

立即注册开发者竞赛,开始构建您的下一代 AI 应用程序。

第一步:立即开始

注册参加比赛,利用我们的资源开始您的项目。

在 NVIDIA 开发者 Discord 频道【1】和 NVIDIA 开发者论坛【2】上与 LLM 开发者社区以及 NVIDIA 和 LangChain 的技术专家联系。

第二步:设置并构建您的项目

搭建开发环境并构建您的项目。使用以下任一 NVIDIA 技术以及 LangChain/LangGraph 框架来开发您的代理应用程序。

通过 NVIDIA NIM API 或端点使用基础模型

NeMo Curator

NeMo 框架

NeMo Guardrails

NVIDIA TensorRT-LLM

第三步:在社交媒体上分享

在 X(Twitter)、LinkedIn 或 Instagram上发布一段 45 到 90 秒的生成式 AI 项目演示视频,并使用 hashtag #NVIDIADevContest 和 #LangChain。同时,请给以下其中一个 NVIDIA 社交媒体账号打标签:

X(Twitter): @NVIDIAAIDev

LinkedIn: @NVIDIAAI

Instagram: @NVIDIAAI

第四步:提交您的参赛作品

完成后,请提交所有资料,包括源代码链接、演示视频、社交媒体发布内容以及任何其他补充材料。要获得合格的参赛资格,必须在提交表格上填写所有必需字段。

比赛过程需要构建什么

在以下类别中创建您的下一个 GPU 加速生成式 AI agent 项目。

大型语言模型(超过 80 亿参数)

大型语言模型(LLM)——拥有超过 80 亿个参数,正在从基于 GPT 的模型到 Llama、Gemma 和 Mixtral 等模型不断发展。开发者可以利用这些大型模型构建用于问答、摘要和内容生成等任务的多种代理。

小型语言模型(80 亿参数或更少)

随着模型越来越大,一股新浪潮正在推动小型语言模型(SLM)的发展,这些模型拥有 80 亿个参数或更少。对于这一选项,鼓励开发者使用这些小型语言模型来构建本地协同应用程序或设备上的应用程序。

获胜者选择标准

合格的参赛作品将按以下标准进行评判:

实际应用:评估项目在解决现实世界挑战方面的影响力和新颖性,以及针对目标受众的易用性

技术整合:评估开发人员在项目中有效使用 NVIDIA 的 LLM 产品和 LangChain 技术的程度

提交质量:审查项目细节、说明和演示的全面性和清晰度

奖品

参与者将有机会赢取 GPU 和数百美元的 LangChain 奖品,继续他们的学习之旅:

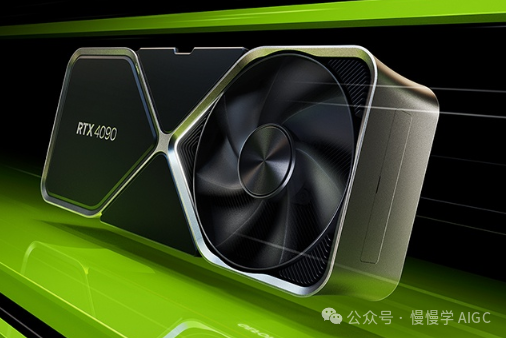

两位获胜者将各获得一块 NVIDIA GeForce RTX 4090 GPU。

一位特别提及将获得一块 NVIDIA GeForce RTX 4080 SUPER。

前 10 个项目将各获得 200 美元的 LangSmith 积分和 LangChain 商品。

前 100 个项目将各获得一门 NVIDIA深度学习研究院 LLM 课程。

所有有效参与者都将获得由 NVIDIA 首席执行官詹森·黄签名的数字参与证书。

想参赛的同学,抓紧时间恶补下基础知识:

使用 GPTQ、AWQ 和 Bitsandbytes 进行模型量化

利用 ChatRTX 搭建本地对话机器人

什么是检索增强生成(Retrieval-Augmented Generation)

点击下方卡片,关注“慢慢学AIGC”