关注公众号回复“激活码”,获取最新IDEA激活码

DeepSeek-R1采用MoE架构,支持从1.5B到1.8T参数的弹性部署,具备高效推理和低显存占用优势。文章详细列出不同版本的硬件需求,包括CPU、GPU、存储和内存配置,并针对轻量级、企业级和科研级部署给出具体适用场景。同时,提供量化加速、显存优化和分布式部署等性能优化建议.自然语言处理(NLP)技术已成为数字化转型的核心驱动力,最近爆火的DeepSeek-R1作为新一代智能语言模型,在语义理解、推理能力和生成质量方面实现突破性进展,DeepSeek团队也成功证明,较大模型的推理模式可以被提炼成较小的模型,与通过RL在小模型上发现的推理模式相比,可以获得更好的性能。结合最新硬件发展趋势,提供精准的部署版本选择建议,希望能帮你在不同场景下最大化发挥模型效能。

DeepSeek-R1模型概述

该模型系列采用MoE(Mixture-of-Experts)混合专家架构,支持从移动端到超算集群的弹性部署:

参数规模:覆盖1.5B至1.8T参数,支持动态子模型激活

技术特性:集成Flash Attention 3、动态量化推理和专家路由优化

性能优势:相比传统架构,推理速度提升40%且显存占用降低30%

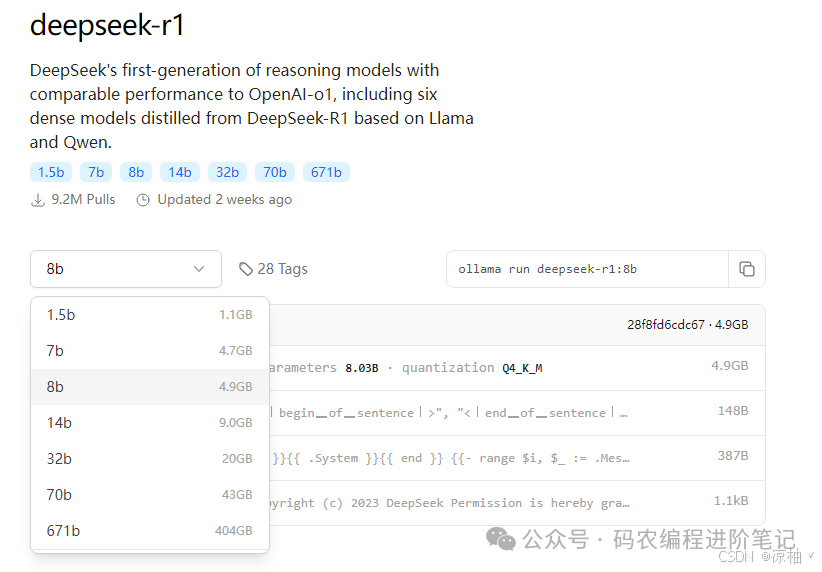

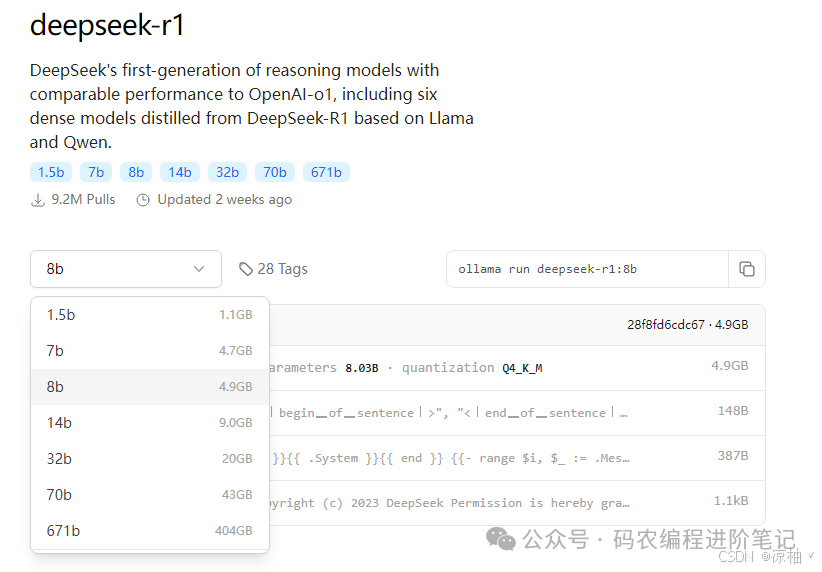

通过ollama下载 DeepSeek-R1模型地址:deepseek-r1

硬件要求

根据计算密度需求提供两套配置方案:

| | | | | |

|---|

| | (非必需) NVIDIA RTX 3050 6GB | | | |

| | 至少RTX 3060 12GB 推荐:RTX 4070 Ti Super 16GB | | | |

| | 推荐:RTX 4090 24GB | | | |

| | 2x RTX 5090 32GB(NVLink互联) | | | |

| | 8x H100 80GB(InfiniBand互联) | | | |

硬件选型建议

CPU:推荐AMD Zen4或Intel Sapphire Rapids架构,支持AVX-512指令集

GPU:NVIDIA Ada Lovelace架构(RTX 40/50系列)或Hopper架构(H100)

存储:PCIe 5.0 NVMe SSD,建议配置RAID 0提升I/O性能

内存:DDR5 5600MHz以上,支持ECC校验

适用场景

轻量级部署

企业级部署

科研级部署

性能优化建议

量化加速:使用FP8/INT8量化提升推理速度

显存优化:启用ZeRO-3优化器减少显存占用

分布式部署:采用Tensor Parallelism+Pipeline Parallelism

缓存机制:实现KV Cache优化

注意事项

确保硬件兼容性,特别是GPU驱动版本

部署前进行完整的压力测试

配置完善的日志系统

制定应急预案

在模型部署后,建议持续监控系统资源使用情况,以确保模型运行稳定。可以使用工具如htop

或nvidia-smi

来监控CPU、内存和显存的使用情况。