本期将分享近期全球知识图谱相关

行业动态、近期会议、论文推荐

Franz Inc.与罗格斯大学合作推进AI知识图谱

2025年5月19日,Franz Inc.与罗格斯大学宣布达成多年战略合作,共同探索神经符号AI(Neuro-Symbolic AI)在生物医学信息学、教育和健康公平领域的知识图谱应用。双方将利用Franz的AllegroGraph平台,开发智能数据集成管道,将非结构化文本转化为语义丰富的可查询知识图谱,以提升临床数据解读和学术研究的效率。该合作有望加速医疗发现与教育创新。

https://t.hk.uy/bS2g

数字人+知识图谱

5 月 20 日,名为“跨越时空的对话”的老子数字人发布暨线上推广仪式在素有“千年战略关道发祥地”之称的汉沽关历史文化旅游区举行。这标志着老子的中国第一个数字人,融合了人工智能、3D 建模和自然语义交互等尖端技术。项目依托对超过 100,000 条哲学注释的研究,构建了“道德经语义知识图谱”,以《道德经》等哲学著作为中心,实现实时人机交互和对话。

CCF 2025中国信息系统战略研讨会(FISS 2025)

会议将于2025.06.06 ~ 06.08在新疆维吾尔自治区石河子市举行。信息系统是社会各领域以处理信息流为手段从而实现业务目标的人机友好系统。在当今数字化转型与数字经济时代,随着人工智能、区块链、物联网、知识图谱、可视化等技术的迅猛发展,为应对不断关注的领域应用需求和外部环境数据的情景变化而带来的全新挑战,信息系统正在由传统的人机友好系统习近平总书记指出:要推动互联网、大数据、人工智能和实体经济深度融合,建设数字中国、智慧社会,推进产业数字化和数字化,打造具有国际竞争力的数字产业集群。

详情访问:https://ccf.org.cn/FISS2025

第23届中国数据库暑期学校将于2025年7月14日--7月20日在中国天津举办成。中国国数据库暑期学校下属中国计算机学会数据库专业委员会,旨在为中国从事或有志从事数据库理论与技术研究的教师、学者和研究生提供一个学习和交流的机会。学院每年不定期地邀请数据库及相关领域国际的学者来中国讲学,以促进我国国际数据库学科前沿全面及时了解,并在此前提下,立足于有特色的数据管理技术和系统的应用研究。

详情访问:https://ccf.org.cn/ADL158

本周推荐的是arxiv 2025.5上的论文:Learning to Think: Information-Theoretic Reinforcement Fine-Tuning for LLMs

简介

大型语言模型 (LLM) 在各种任务中都表现出了显著的能力,但提高它们的推理能力同时保持计算效率仍然是一项重大挑战。目前的方法通常导致不必要的长推理链,浪费计算资源,而没有成比例的准确性提升。

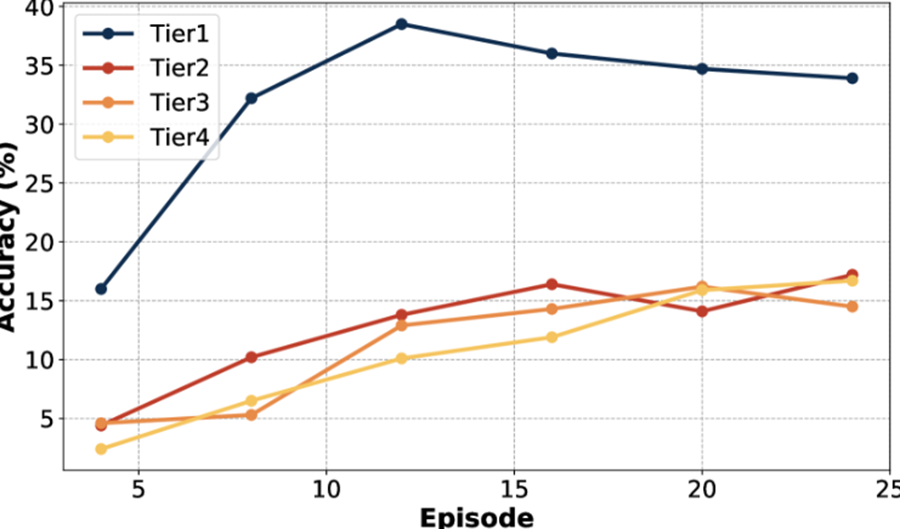

图 1:不同难度等级的推理集数对应的准确率进展,显示了尽管持续消耗tokens,性能在某些点之后如何趋于稳定。

这篇论文 "Learning to Think: Information-Theoretic Reinforcement Fine-Tuning for LLMs",由中国科学院大学、中国科学院软件研究所和香港科技大学的研究人员撰写,解决了推理有效性和计算效率之间的这一基本张力。作者介绍了一种名为 Learning to Think (L2T) 的新框架,该框架利用信息论来指导 LLM 的微调,使模型能够以更少的 tokens 更有效地进行推理。

与依赖于基于结果的奖励或特定于任务的过程奖励的现有方法不同,L2T 提供了一个与任务无关的、密集的流程奖励系统,用于量化每个推理步骤的信息增益。这使得模型可以根据收益递减来学习何时停止推理,而不是任意的截断。

背景和动机

目前增强 LLM 推理能力的方法通常分为两类:

基于结果奖励的方法:这些方法仅在推理过程结束时提供反馈,这通常鼓励模型生成不必要的长推理链,以期最终得出正确的答案。

特定于任务的过程奖励方法:这些方法提供逐步指导,但需要昂贵的手动注释,并且不能很好地推广到不同的任务。

L2T 背后的关键动机是开发一种通用的、与任务无关的方法,可以自适应地平衡推理深度和计算效率。作者观察到,没有固定的推理链长度对于所有问题都是最佳的——有些问题需要大量的推理,而另一些问题可以通过更少的步骤有效地解决。

考虑数学推理问题:对于简单的问题,将推理扩展到几个步骤之外通常不会增加太多价值,而复杂的问题则受益于更深入的探索。 L2T 旨在教会模型识别这种收益递减点并相应地优化他们的推理。

论文、讨论链接:https://www.alphaxiv.org/overview/2505.10425,感兴趣的读者可以关注。

更多链接

内容:袁知秋、程湘婷、卢小柯、王图图

诚邀您加入我们的gStore社区,我们将在群内解决使用问题,分享最新成果~

请在微信公众号图谱学苑发送“社区”入群~

微信社区群:请回复“社区”获取