前面简单对显卡显存有了大体的了解,但大叔有时候还是蒙蒙的,会有疑问“显卡就是GPU么” ?

AI时代不懂得就得先问问各种AI助手。

GPU和显卡的关系

显卡与GPU的关系可以概括为:

GPU是显卡的核心处理单元,而显卡是包含GPU及其他组件的完整硬件系统。

图形处理器(Graphics Processing Unit, GPU),是专门负责图形渲染和并行计算的芯片,拥有数千个计算核心,擅长处理图形渲染(如3D建模、游戏画面)及通用计算(如AI训练、科学模拟)等。

类比来说,GPU如汽车发动机,显卡如整车——发动机(GPU)决定动力,但整车需底盘、油箱(显存、散热等)配合才能行驶。总结:GPU仅是显卡的核心组件,如同“发动机≠汽车”。

通常而言,一款显卡会对应相应的GPU型号,例如NVIDIA GeForce RTX 5070 显卡的 GPU 型号为 GB205。

通过搜索知道,RTX 5070移动版显卡是NVIDIA在2025年推出的50系中高端显卡,采用Blackwell架构,拥有4608个CUDA核心以及8GB GDDR7显存,128bit位宽设计,支持光线追踪和DLSS 4.0技术。

CUDA什么?

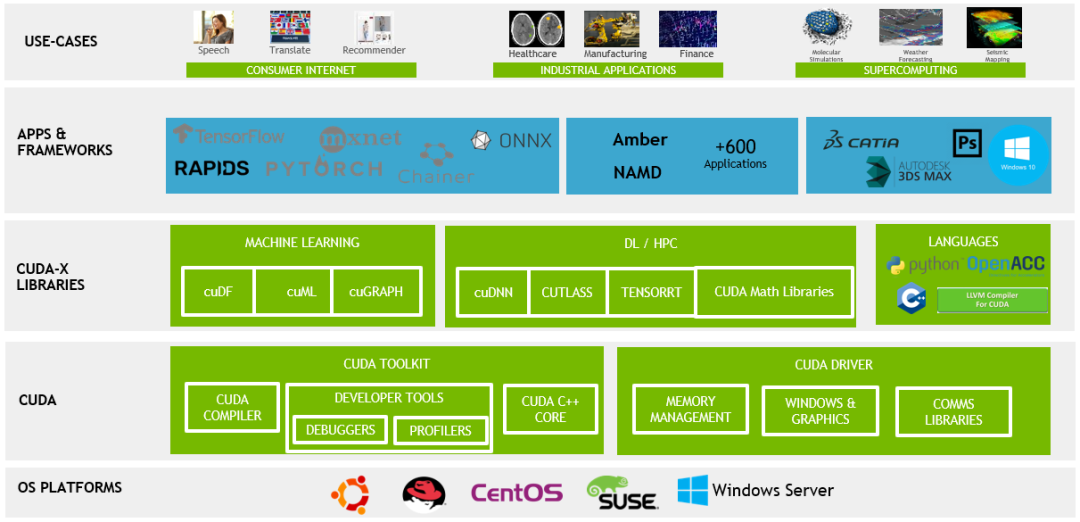

来源:https://blogs.nvidia.com/blog/what-is-cuda-2/

CUDA(Compute Unified Device Architecture,统一计算设备架构)是英伟达(NVIDIA)推出的并行计算平台和编程模型,涵盖软件和硬件相关的一整套计算体系,包括 CUDA Toolkit(含编译器、库等开发工具)、CUDA 驱动、针对多种编程语言的扩展等。它让开发者能借助 GPU 的并行计算能力加速通用计算任务(程序运行)。

CUDA核心是GPU中处理浮点/整数运算的最小单元(GPU的基础计算单元),是构成 GPU 并行计算能力的基础硬件单元,是物理实体。

CUDA 核心作为 GPU 并行计算的执行单元,是 CUDA 技术实现高性能计算的硬件基础。在 CUDA 平台下,大量 CUDA 核心协同工作,承担具体计算任务,在 CUDA 架构支持下,在加速深度学习模型训练、3D 图形渲染、分子模拟等计算密集型任务中发挥核心作用。

CUDA核心数量决定GPU的并行任务吞吐上限,但实际性能需结合架构、显存、功耗及系统平衡性综合考量。例如,RTX 5070的4608个CUDA核心可同时处理海量数据,加速AI训练和图形渲染。

另外,各个厂家的RTX 5070显卡虽基于相同的NVIDIA GPU,但由于厂商在产品定位、散热设计、功耗调校等方面的差异,实际性能表现、稳定性和使用体验会有区别。

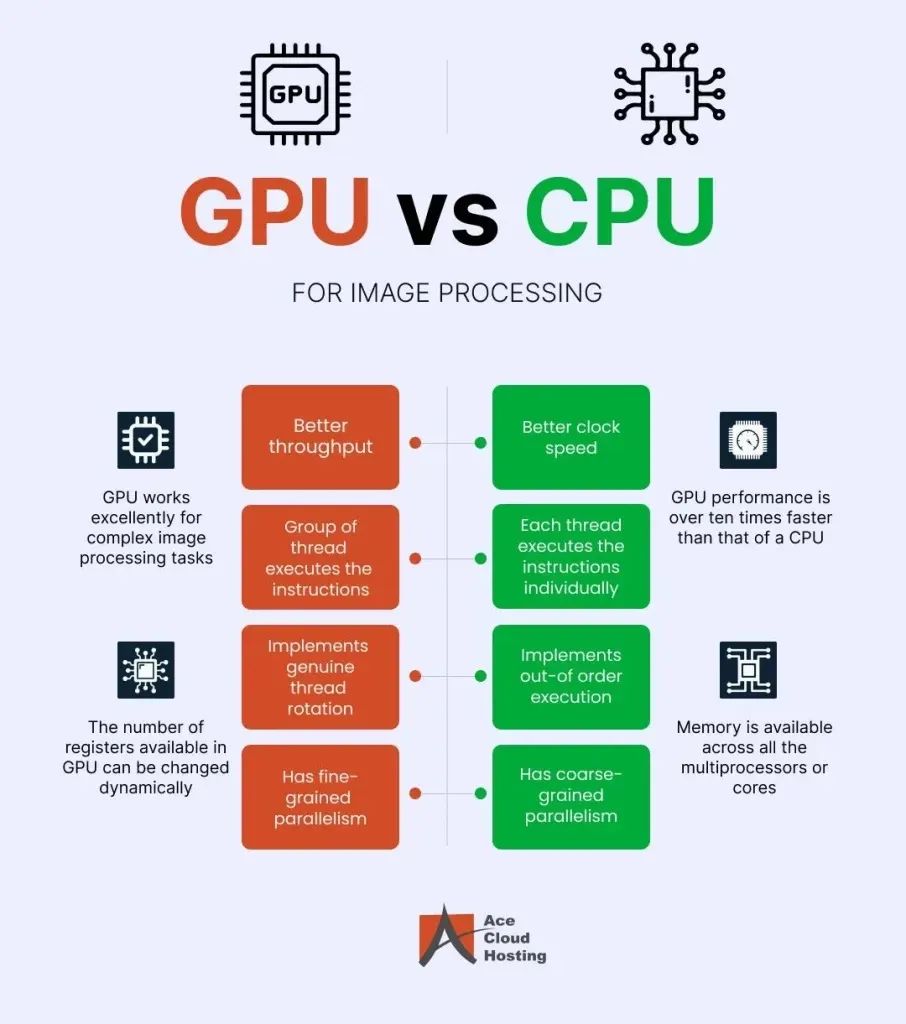

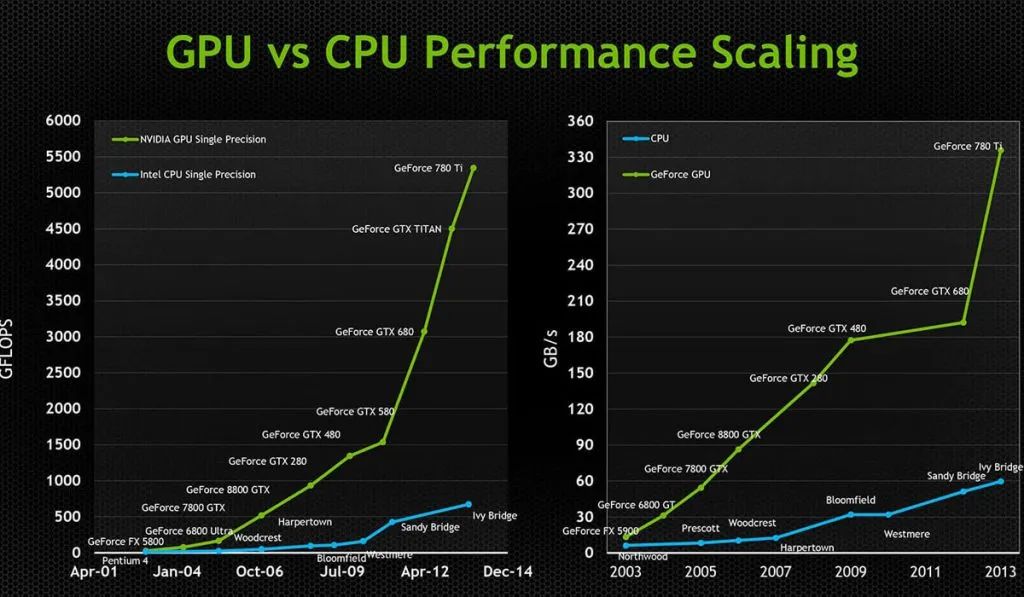

CPU和GPU有啥区别?

CPU(中央处理器)和GPU(图形处理器)都是选择电脑的重要指标。

在运行大模型(训练与推理)时,GPU 的核心重要性显著高于 CPU,但 CPU 的协同作用不可替代。

| 对比维度 | CPU(中央处理器) | GPU(图形处理器) |

|---|---|---|

| 设计目标 | ||

| 核心功能 | ||

| 核心数量 | ||

| 缓存容量 | ||

| 逻辑单元占比 | ||

| 指令集 | ||

| 单线程性能 | ||

| 并行计算能力 | ||

| 典型应用场景 | - 系统内核任务调度 - 复杂逻辑计算(如金融风险建模) | - 深度学习训练(TensorFlow/PyTorch) - 大数据并行处理、气象模拟 |

| 类比说明 |

CPU:是计算机的 “大脑”,主要处理程序、操作系统等指令,能进行复杂计算、逻辑操作和决策,还能快速切换任务,适合多任务处理。它通常有 4 到 64 个核心,每个核心有缓存, clock speed(时钟速度)以 GHz 为单位,比如 3.0 GHz 的 CPU 每秒可处理 30 亿条指令。不过,CPU 不擅长对大量数据重复执行相同任务,比如给视频做色彩校正时,若用 CPU 逐个处理像素,会耗费大量时间和资源。

GPU:是专门处理图形渲染的电子电路,有数千个更小、更简单的核心,可并行处理大量数据,适合高吞吐量和并行性任务,像 3D 图形渲染中的浮点运算、机器学习中的矩阵运算等。但 GPU 不擅长需要顺序处理或低延迟的不同任务,比如打开文件或加载网站时,得等 CPU 发送指令和数据,会拖慢进程。

来源:https://blogs.nvidia.com/blog/whats-the-difference-between-a-cpu-and-a-gpu/

结论:对于涉及大量可通过简单算术运算并行处理的数据任务,GPU 计算比 CPU 计算更快。

未完待续。。。