点击上方👆蓝字关注我们!

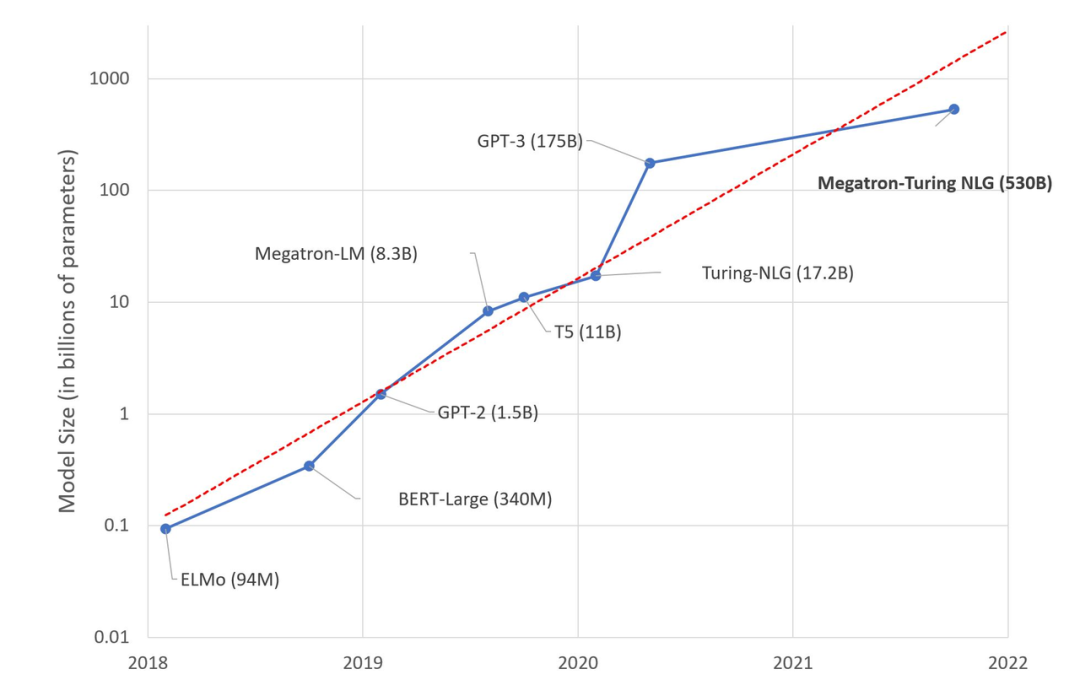

背景

火山引擎大模型训练框架 veGiantModel

同时支持数据并行、算子切分、流水线并行 3 种分布式并行策略,同时支持自动化和定制化的并行策略; 基于 ByteCCL 高性能异步通讯库,训练任务吞吐相比其他开源框架有 1.2x-3.5x 的提升; 提供了更友好、灵活的流水线支持,降低了模型开发迭代所需要的人力; 可在 GPU上高效地支持数十亿至上千亿参数量的大模型; 对带宽要求低,在私有化部署无 RDMA 强依赖。

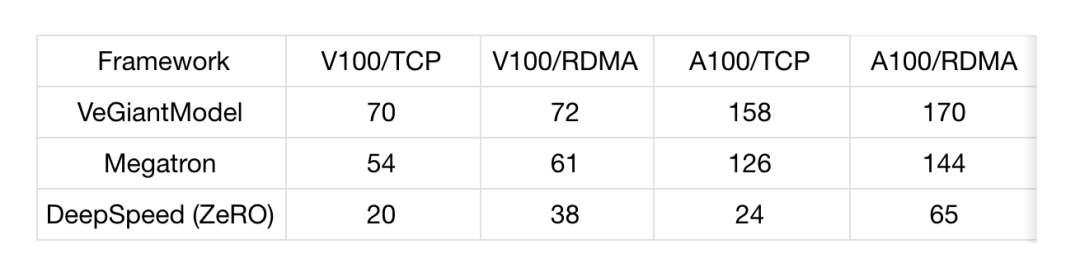

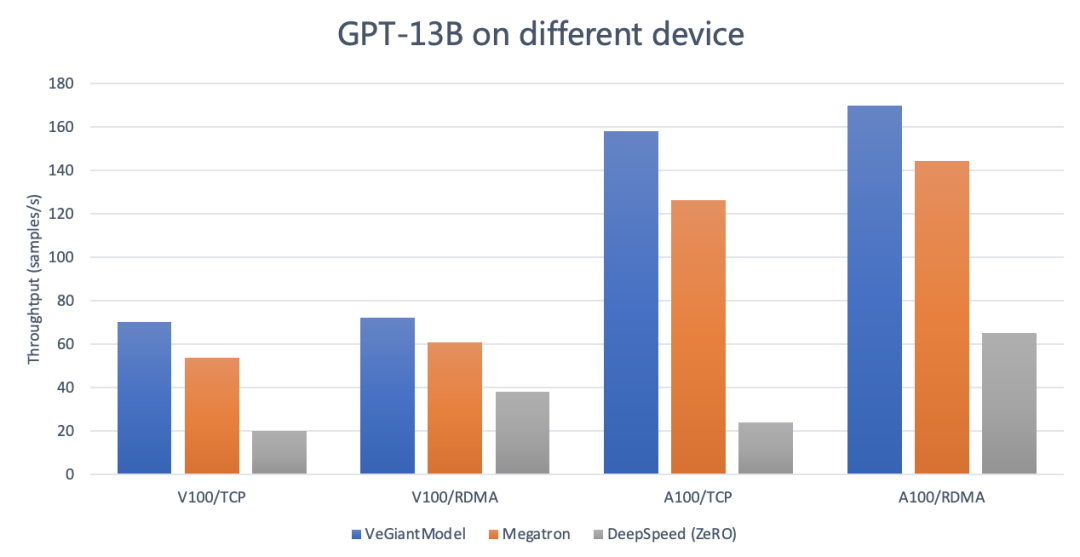

veGiantModel 性能表现

V100 测试:每个机器 8 张 Tesla V100 32G 型号 GPU,网络带宽 100G A100 测试:每个机器 8 张 Ampere A100 40G 型号 GPU,网络带宽 800G

模型:GPT-13B Megatron:v2.4,tensor-model-parallel-size 设置为 4, pipeline-model-parallel-size 设置为 4 DeepSpeed:v0.4.2,使用 DeepSpeedExamples 开源社区中默认的 zero3 的配置 运行环境 V100/TCP :100Gb/s TCP 网络带宽,4 机,每机 8 张 Tesla V100 32G GPU V100/RDMA:100Gb/s RDMA 网络带宽,4 机,每机 8 张 Tesla V100 32G GPU A100/TCP:800Gb/s TCP 网络带宽,4 机,每机 8 张 Tesla A100 40G GPU A100/RDMA:800Gb/s RDMA 网络带宽,4 机,每机 8 张 Tesla A100 40G GPU 统计值:Throughtput (samples/s)

从上述数据可以看出:

veGiantModel 性能更优:无论是在高带宽还是低带宽的场下,veGiantModel 在 V100 和 A100 上均胜出 Megatron 和 DeepSpeed,最高可达 6.9 倍提升。 veGiantModel 对网络带宽要求低:veGiantModel 在带宽变化对吞吐的影响相对最小 (<10%),而 DeepSpeed(ZeRO) 是对带宽要求最高的,最高可达将近 5 倍的差距。

ByteCCL (BytePS) 高性能异步通讯库。 支持定制化的并行策略,可以将性能优化推到极致。 在支持数据并行、算子切分、流水线并行 3 种分布式并行策略时,veGiantModel 会综合考虑到跨机的带宽,自动调整 toplogy 的 placement。

传送门

文章转载自火山引擎开发者社区,如果涉嫌侵权,请发送邮件至:contact@modb.pro进行举报,并提供相关证据,一经查实,墨天轮将立刻删除相关内容。