点击上方 蓝字关注我们

https://arxiv.org/pdf/2010.01804.pdf

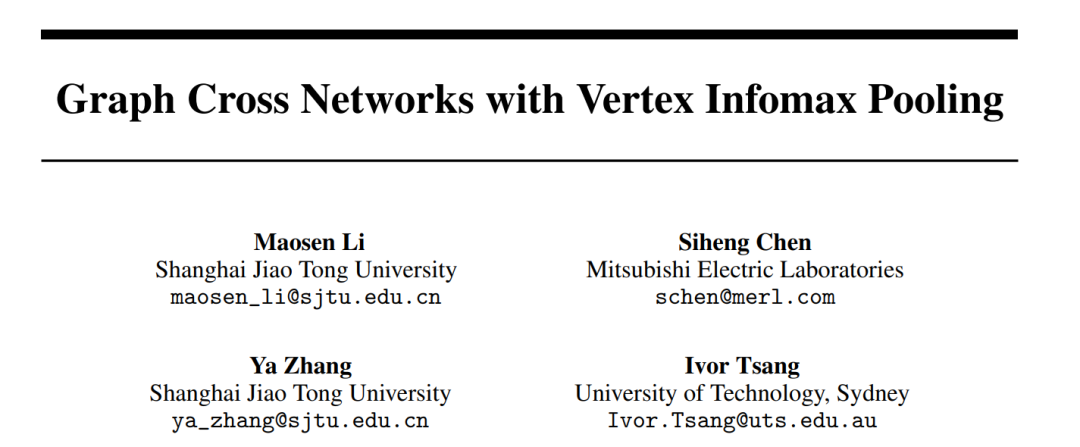

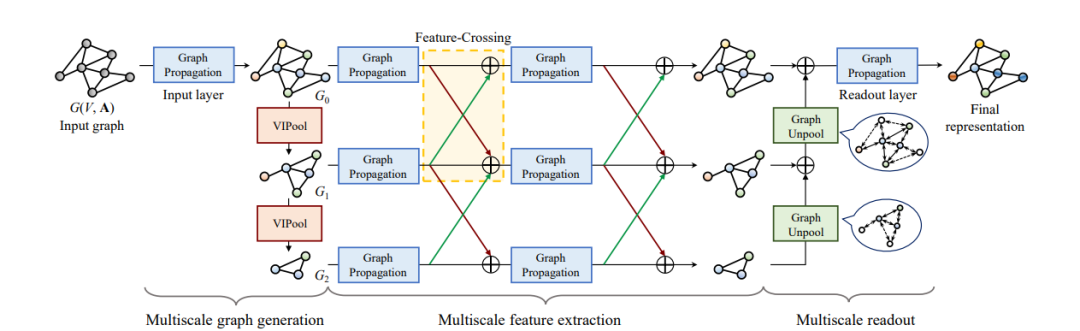

本文提出了一种多图学习网络(graph cross network,GXN),从图的多个尺度进行全面的特征学习。框架图如下所示:

GXN实现了一种可微分,可学习的多层次表示网络,GXN允许跨比例交换中间特征以促进信息流。GXN的设计包含了两个关键的要素:一个是顶点信息最大合并(vertex infomax pooling,VIPool)和一个是不同sacle特征交互学习,后者可以以可训练的方式学习多尺度图,并且可以进行跨尺度交换特征。

本文提出的VIPool根据顶点特征和邻域特征之间互信息来选择信息量最大的顶点集。直观理解是,当一个顶点可以最大程度地反映其邻近信息时,它才是具有信息性的。

本文提出的特征穿越层将两个尺度之间的中间特征融合在一起,以通过改善信息流和丰富隐藏层的多尺度特征来相互增强。GXN这种特征交互方式是与许多其他多尺度模型的主要不同之处。实验结果表明,提出的GXN分别将图分类和顶点分类分别提高了1.96%和1.15%。

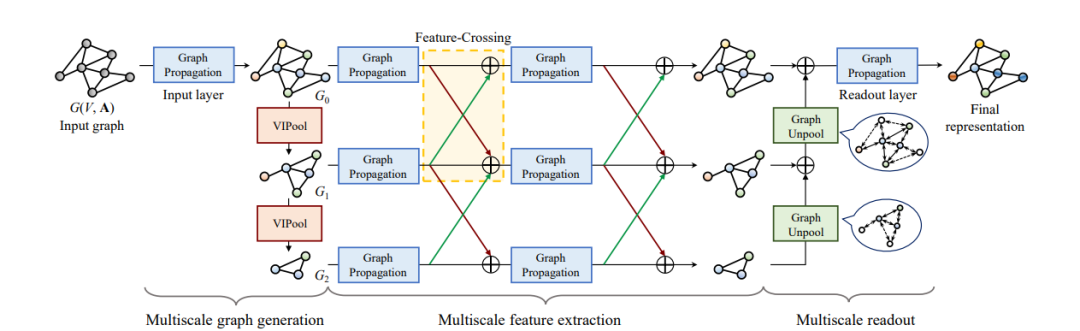

上面是几种常见的模型结构,从模型上看本文的方法主要是在特征的交互学习

VIPool这种操作

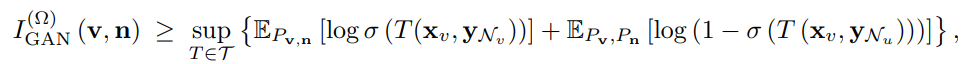

介绍整体模型之前,咱们先看看VIPool这种操作。在此图池化中,该方法选择一定比例的顶点进行保留,并根据原始图结构将它们连接起来。由于缩小图会丢失信息,因此重要的是,在新的合并图中保留尽可能保留多的信息,最大程度地代表原始图。为此,本文的方法是通过相互信息最大化方法,该方法使得保留的顶点能够很好滴表示局部结构。

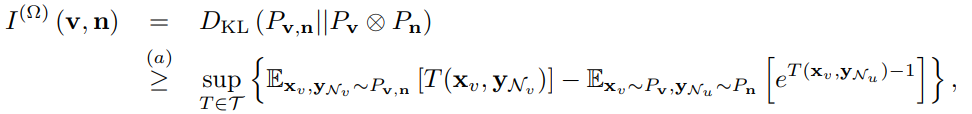

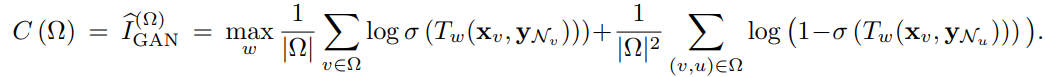

Here we consider a GAN-like divergence:

第一项反映了顶点与邻域之间的亲和力;第二项反映了顶点和任意邻域之间的差异。值得注意的是,较高的C分数表示顶点最大程度地反映了自己的邻域,而最小程度地反映了任意邻域。

如图所示,这里根据顶点可反映其自身邻域的数量以及可与任意邻域区别的数量来评估顶点的重要性。优秀优秀,对比学习的思路用的太好了。

下采样与上采样

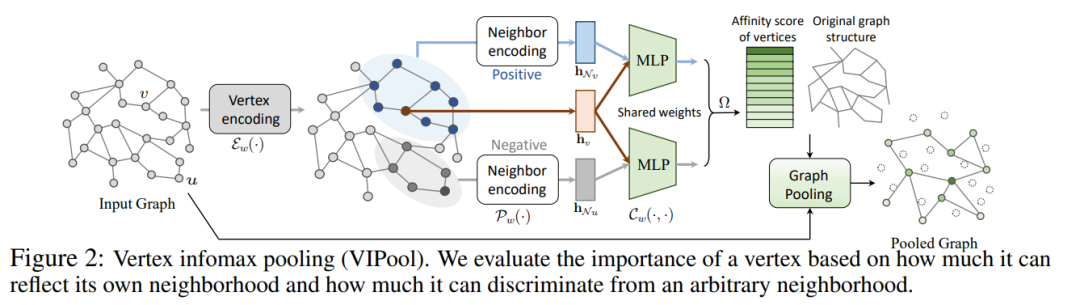

下采样也就是Pooling,Cluster-connection是本文的方法,

为了实现图的上采样,本文设计了一个针对图池化的逆过程。首先为未合并的图数据初始化一个零矩阵;然后根据重新训练的顶点的原始索引获取顶点特征来填充它;接着,通过图传播层对它进行插值,以通过原始图结构将信息从Ω的顶点传播到填充的顶点。图2说明了顶点选择和图池化的总体过程。

多尺度信息的交互

给定多尺度图,在每个尺度上构建图神经网络来提取特征。每个网络由一系列图传播层组成。为了进一步增强跨尺度的信息流,本文在各个网络层的两个连续尺度之间使用特征交叉层,从而允许多尺度特征在中间层进行通信和合并。

经过多尺度特征提取后,将所有尺度的特征组合在一起以获得最终的表示。为了对齐不同比例,采用了VIPool中实现的一系列图池化操作,以将所有的特征转换为原始相同的比例。最后,利用读出传播层进一步嵌入融合的多尺度特征,并为各种下游任务生成图表示。

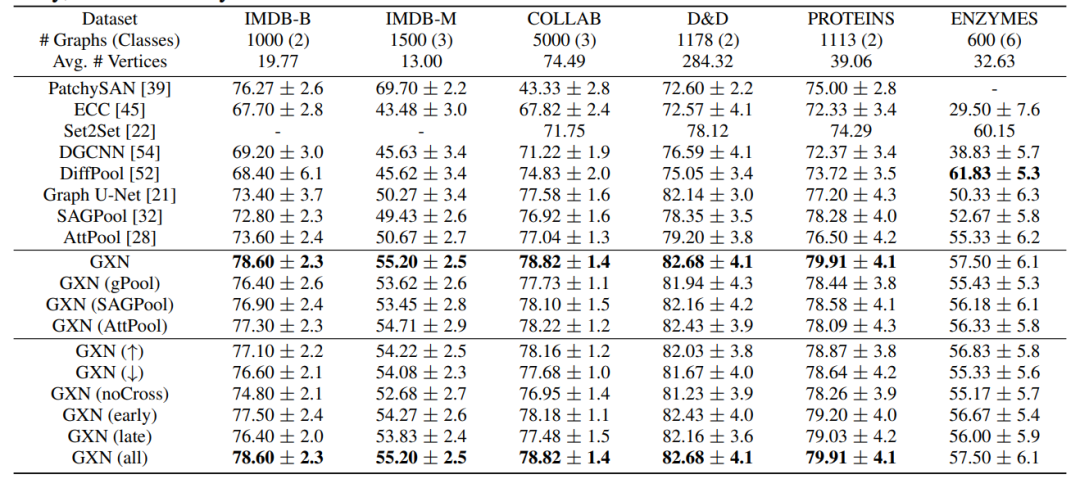

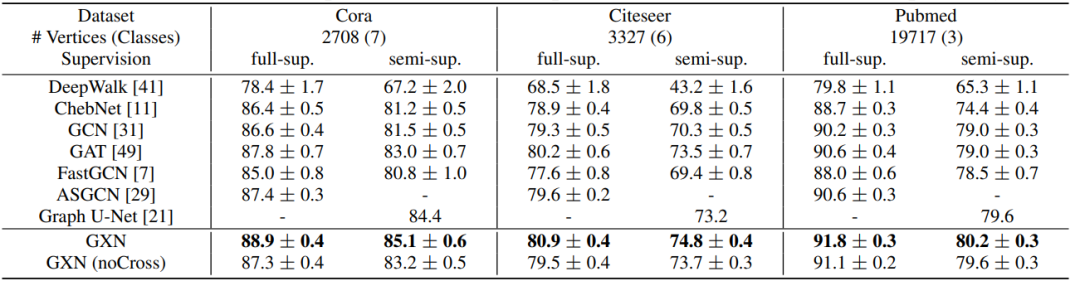

实验结果

图分类和节点分类

总结

本文提出了一种模型图交叉网络(GXN),在该模型中,构建了可在图的多个比例尺上进行特征学习的并行网络,并设计了新的特征交叉层以融合跨多个比例尺的中间特征。为了将图降采样为各种比例,使用顶点信息最大池(VIPool),选择那些最大程度地描述其邻域信息的顶点。基于选定的顶点,对图结构和相应的图数据进行粗化。基于顶点和邻域之间互信息的估计,对VIPool进行了优化。大量实验表明:(i)GXN在图分类和顶点分类优于大多数最新技术;(ii)VIPool优于其他合并方法;(iii)更多中间融合会带来更好的性能。

https://github.com/limaosen0/GXN