劳动节快乐!!!

今天是劳动节,劳动人民的节日。人类之所以能区别其他动物,就是懂得制造和利用工具进行劳动,进而大幅度得解放生产力。今天就讲一下如何用工具来无代码的实现用户行为分析中的Funnel Analysis

对于一个在线上进行运营的企业,无论是电商、游戏、移动应用还是做SaaS类型的在线服务。在日常运营中,转化漏斗分析(Funnel Analysis)是一个非常常用的运营分析方法。

做广告营销,我们会关心展示-》点击-》注册等等转化的漏斗。做日常的运营,电商企业则可能会关心登录-》搜索-》加购-》支付-》支付确认这个转化漏斗的情况,从而去发现用户在哪个阶段流失多,进而去发现问题的原因,然后去修正问题,提高每个阶段的转化率。对于任何企业,只有真正地做到数据驱动的运营,才能真正提高自己的运营效率,使得企业更具有竞争力。

通常来讲,这个企业可以通过一些第三方用户行为统计分析平台来实现转化漏斗分析,比如海外的Google Analytics, Amplitude, Mixpanel。在国内也可以选择免费的TalkingData,友盟等SaaS服务,或者购买神策等私有化部署的产品来实现开箱即用的漏斗分析。

但是用这些产品,都有一个问题就是这些模型都是固定在这些平台当中。客户想要灵活的去做自己的一些设置,就会存在问题。另外,数据也都在这些封闭的平台里边,客户缺乏对数据的完全的控制力。这也就是融资1800万美金,Kubit要颠覆产品分析市场 这个产品为什么会出现的原因之一。

那么,如果不用这些行为分析工具,我们能不能做相关的分析呢?答案显然是可以的。所有的用户行为分析的工具所做的工作基本上包括:行为数据采集、数据清洗、根据指标的模型构建和计算以及可视化报表。

对于行为数据采集,企业可以在自己的网站或者移动应用中直接对用户与网页或者应用进行交互的每个操作进行数据的采集,然后将这些数据发回到自己的数据接收服务。接收到的数据可以以日志的形式存储下来。

企业也可以使用Amplitude等行为分析平台的SDK,进行相关的事件埋点后,配置这些平台的数据的数据导出,这样这些数据就可以以日志的形式导出到S3等对象存储。另外,也可以购买Fivetran的数据同步服务,从而把amplitude收集到的数据导出到snowflake等等数据仓库。‘

数据被采集之后,就可以进行后续的数据清洗、建模以及转化漏斗分析等工作了。对于数据科学家或者数据工程师来讲,大家可以通过python, SQL, R等语言来实现相关的数据清洗和建模操作。不过虽然我自己程序员出身,而且喜欢写程序,不过我更喜欢喜欢写程序来做平台,数据处理的活,如果有好的工具来帮我,我还是喜欢用工具。现在我就来分享一下我如何用快表格这个无代码工具来做转化漏斗分析。

01

数据来源和背景

本文所采用的数据来自于Kaggle这个数据科学论坛,数据集所在地址:

https://www.kaggle.com/code/aerodinamicc/funnel-analysis-and-conversion-rates/data

另外,在Medium上有如何用python基于这个数据集进行转化漏斗分析的博客文章:

https://medium.com/@u3554364/funnel-analysis-of-e-commerce-website-with-real-data-e858e288ffb9

02

数据准备

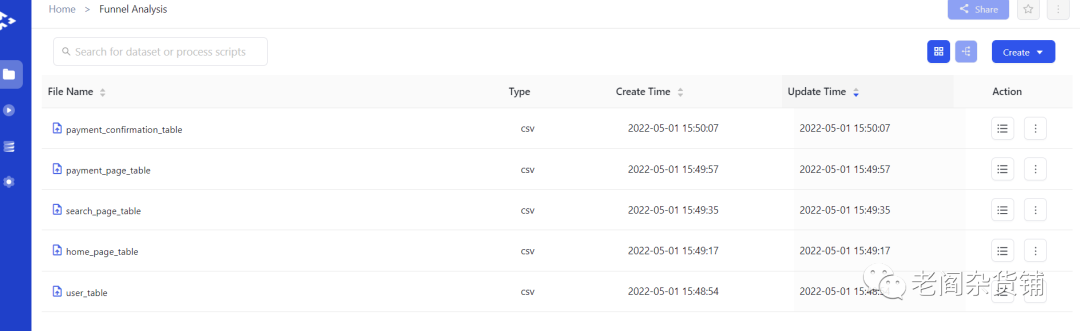

首先从Kaggle下载相关的几个数据文件,分别是user_table.csv, home_page_table.csv, search_page.csv, payment_page.csv和payment_confirmation_page.csv。

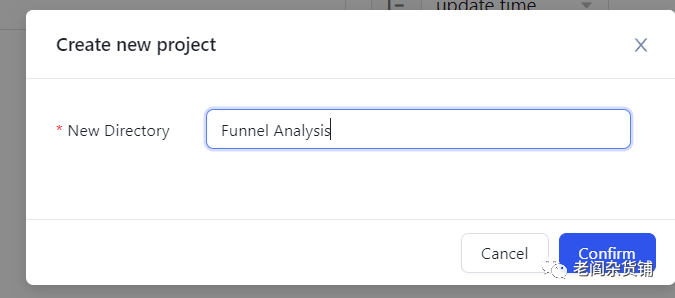

然后打开快表格,创建一个新的项目Funnel Analysis,如下图:

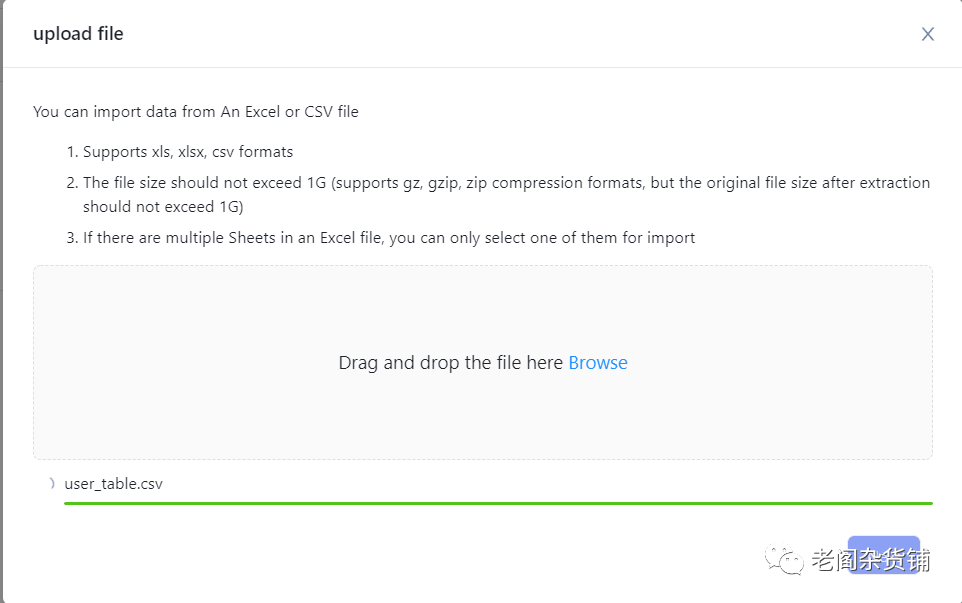

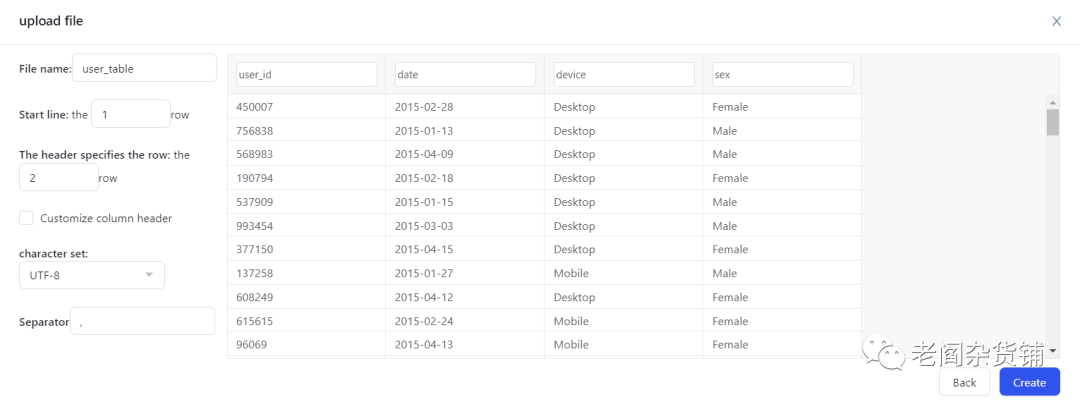

把几个数据文件上传到项目目录中,如下图:

03

数据关联

数据准备好之后,我们首先要把几个文件通过user_id关联成为一张宽表,方便我们后续的计算。

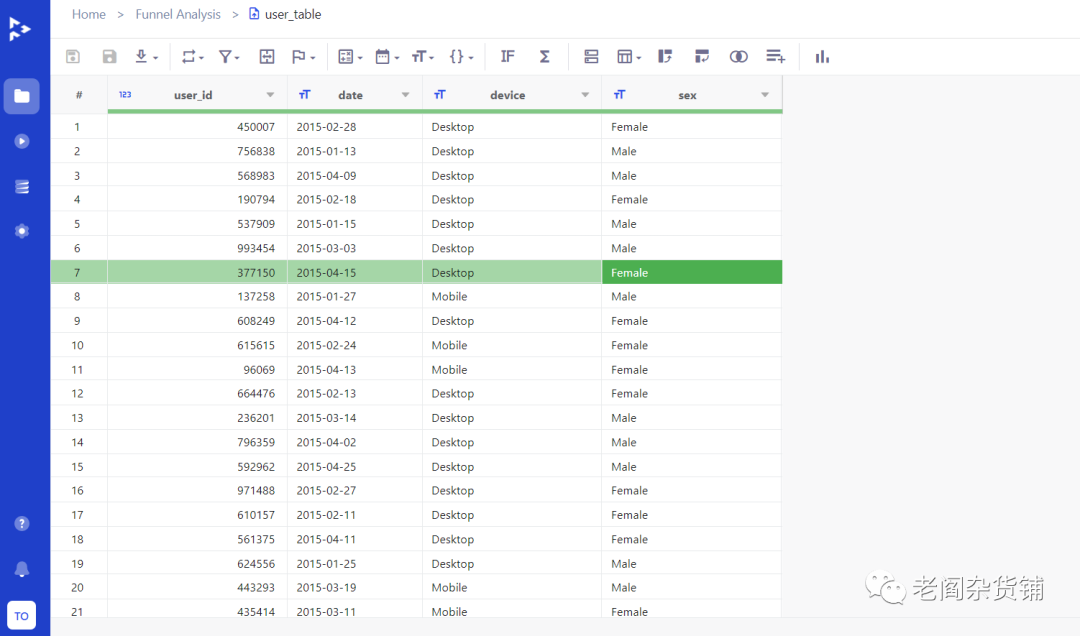

第一步,把user_table和home_page_table做关联,先打开user_table,如下图:

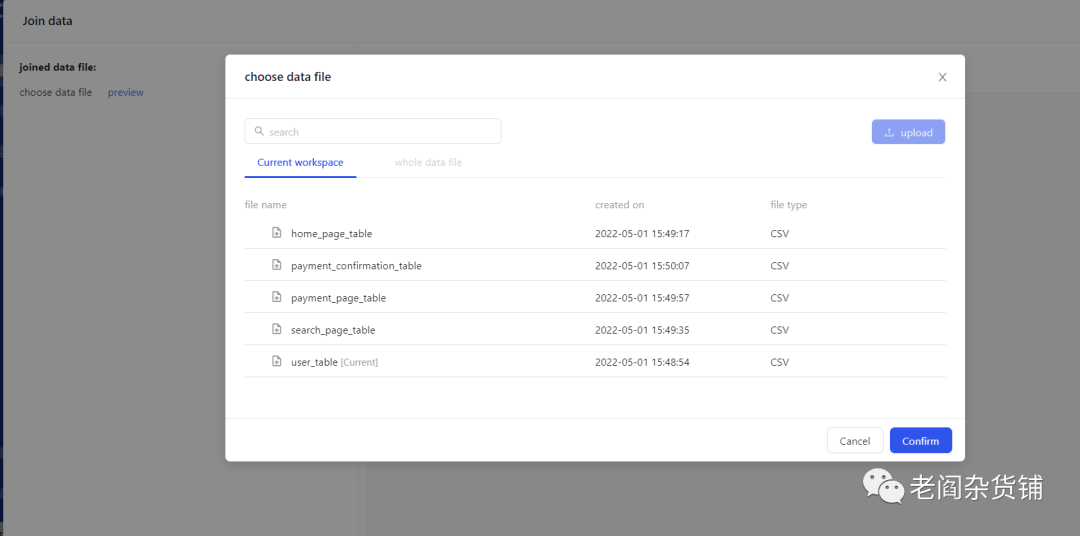

点击join按钮,则进入表关联的操作界面,如下图:

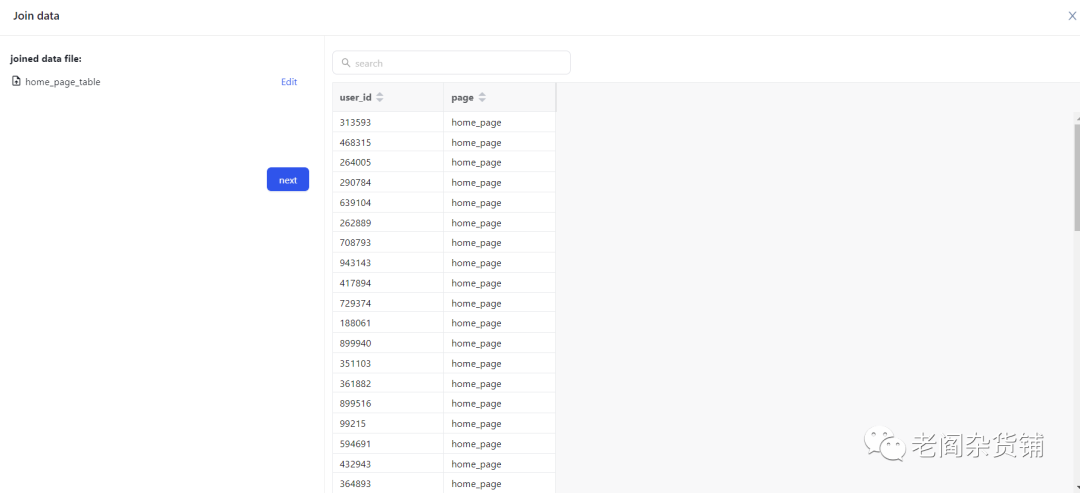

选择home_page_table,点击confirm按钮,则进入如下的界面:

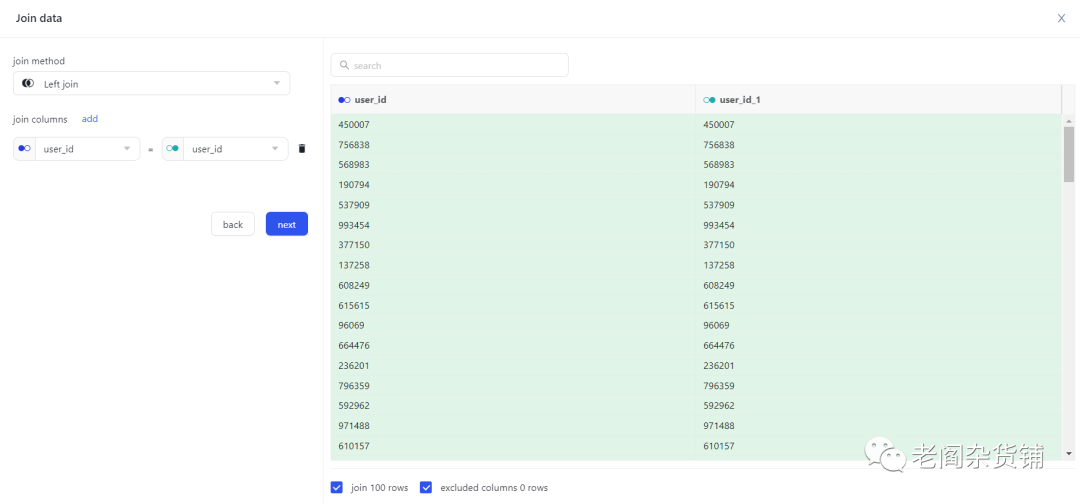

点击next,进入下一步操作,由于我们以user_table表为主表,因此选择Left join。两个表的关联字段都是user_id,如下图:

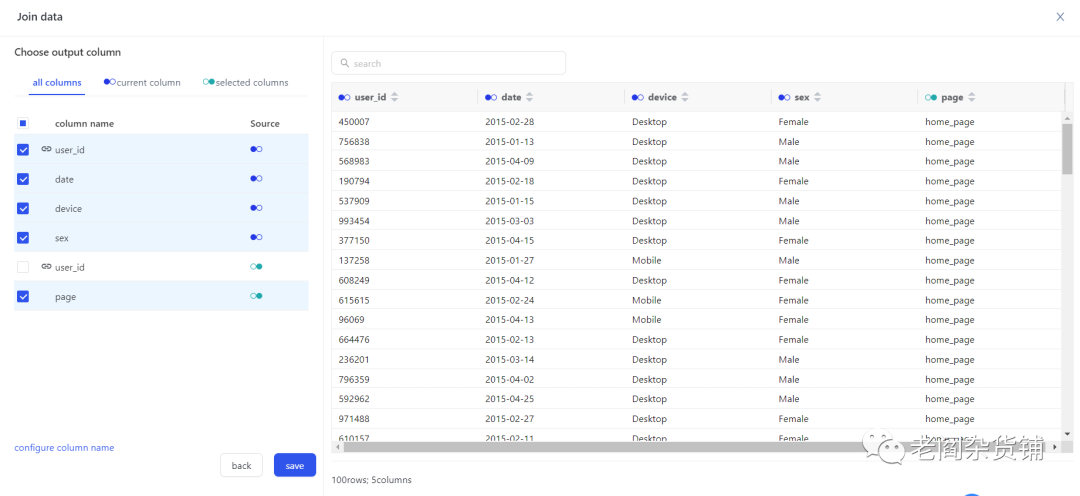

点击next,进入下一步,这时候会列出两个表的所有字段:

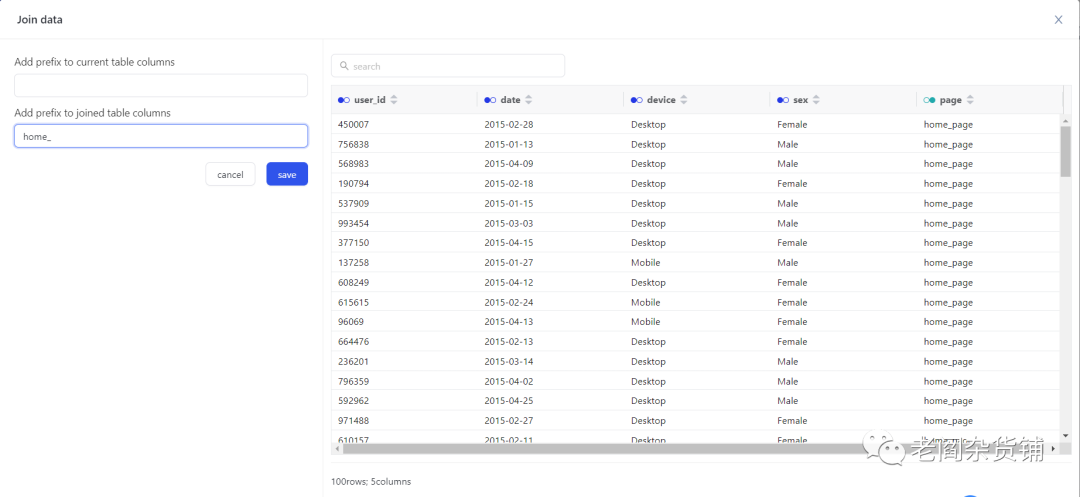

生成的新表我们不需要包含两个user_id字段,因此我不选择第二个表达user_id,但是我需要把第二个表达page字段选上,我可以点击configure column name这个选项来给两个表的不同自动增加前缀,如下图:

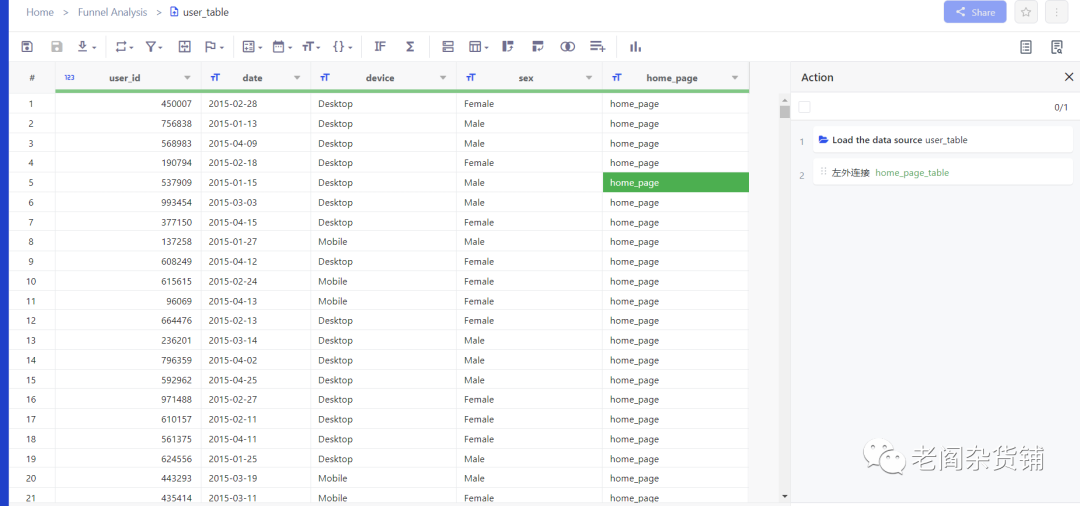

save后,则完成第一个表的关联,关联结果如下:

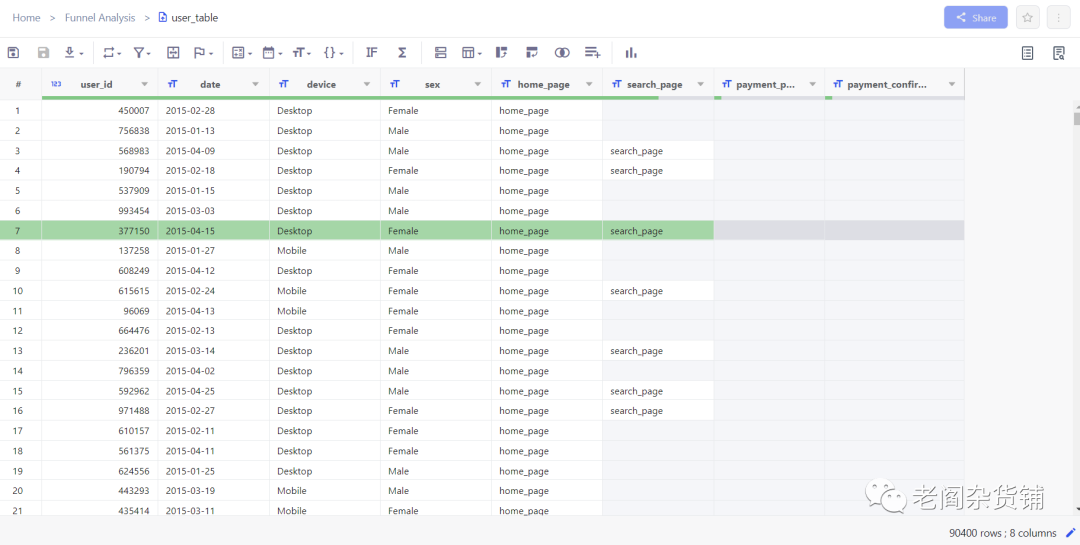

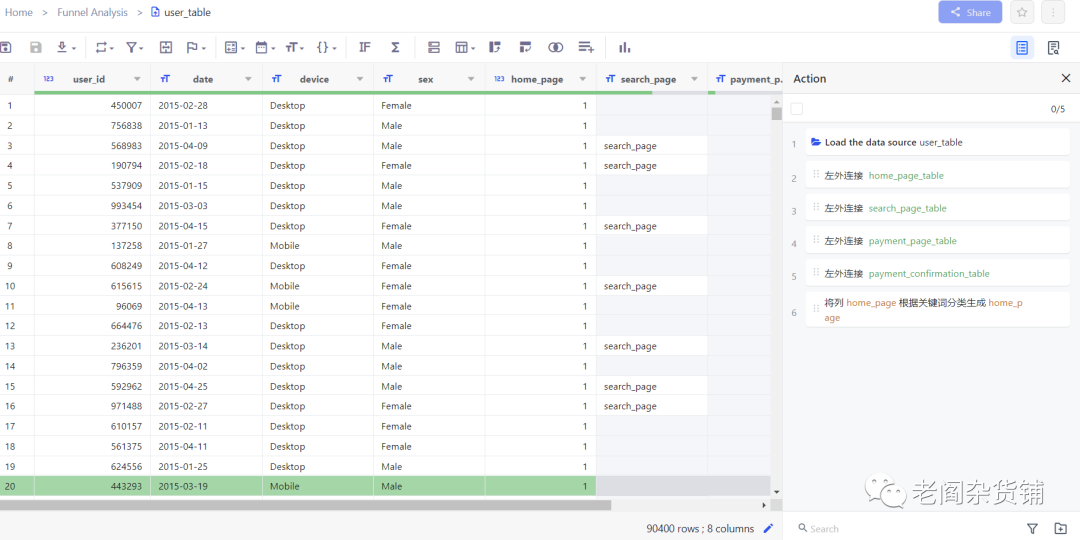

继续重复相关的操作,直到把其余三张表都做关联,最后形成的关联结果如下:

从这个关联的最终表格结果看,search_page, payment_page以及payment_confirmation_page有很多的空值,这就是因为从home page,到后边search page, payment page以及payment confirmtion page逐层都有用户的流失,而做漏斗分析就是要分析相关的转化率,进而发现问题,然后指导后续的产品的优化。

04

数据清洗和转换

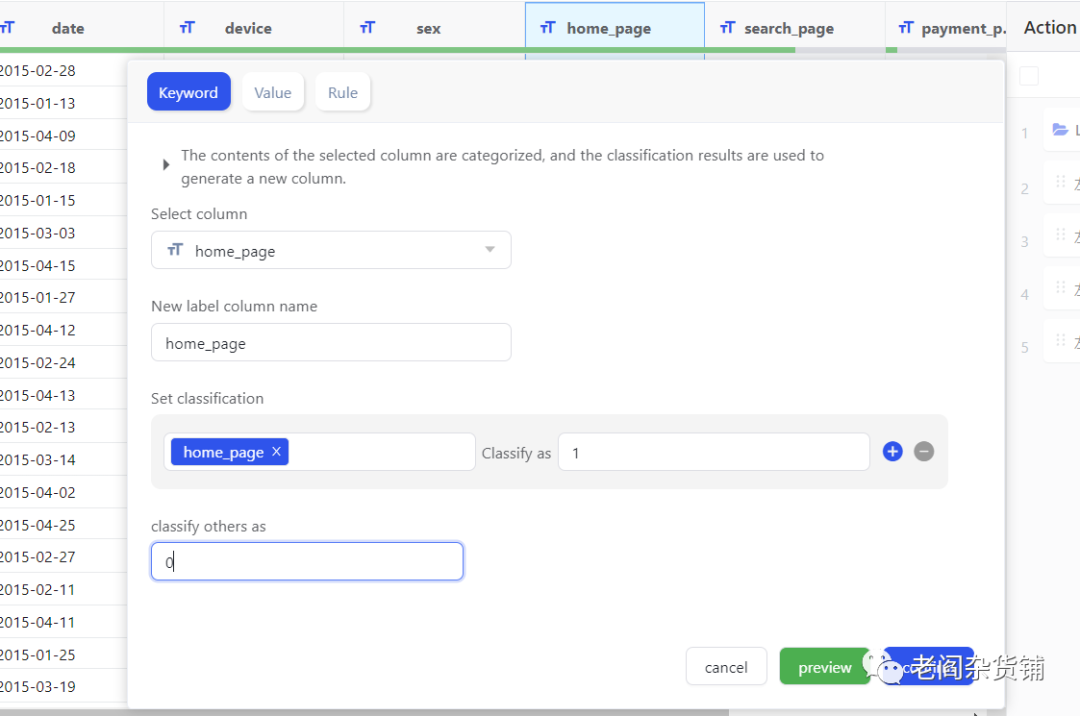

为了方便后续转化漏斗建模,我们需要对表中的数据进行清洗和转换。这个表中的数据相对比较简单,需要做的清洗工作不多。主要的是要把home_page, search_page, payment_page和payment_confirmation_page中的数据要进行一些变化。其中,有内容的数据我们设置为1,为空的我们设置为0,这样我们可以进行后续的转化漏斗计算和问题发现。我们可以使用打标签tag这个功能,比如对于home_page这一列,我们可以如下操作:

确认之后,就变为如下这个样子:

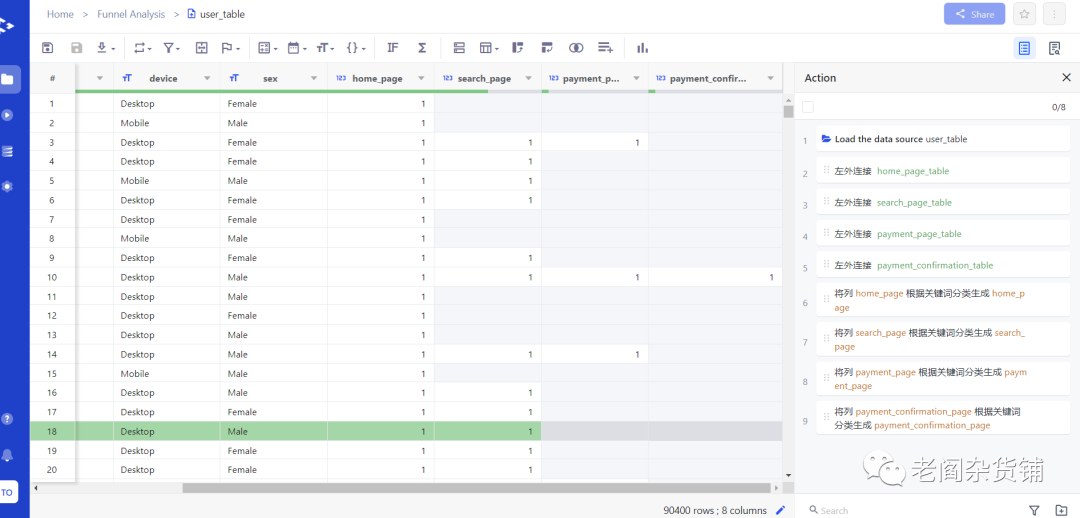

对另外几列做相同的操作,最终结果如下:

05

漏斗分析

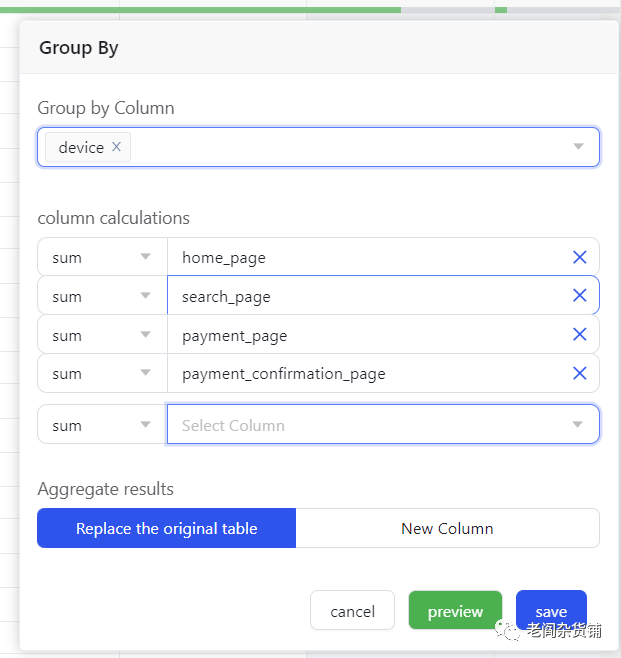

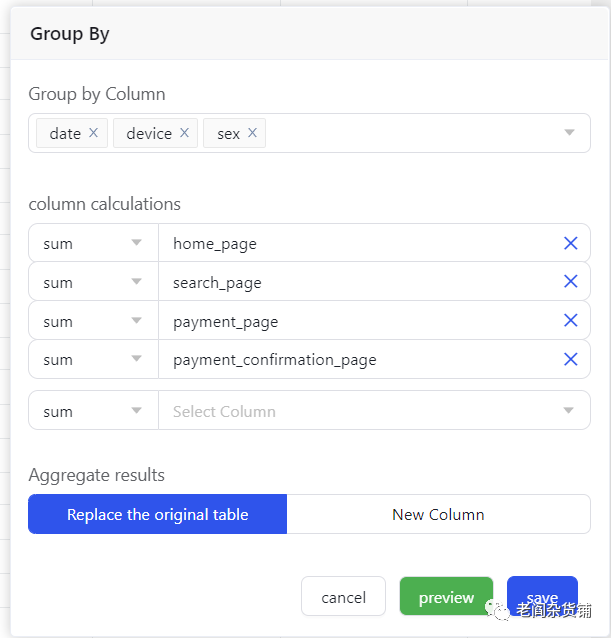

数据整理好之后,我们就可以进行漏斗分析了。我们首先以设备维度进行分组聚合,计算不同设备类型对每个页面的访问量,具体操作方式是点击group操作,出现分组聚合对话窗,如下:

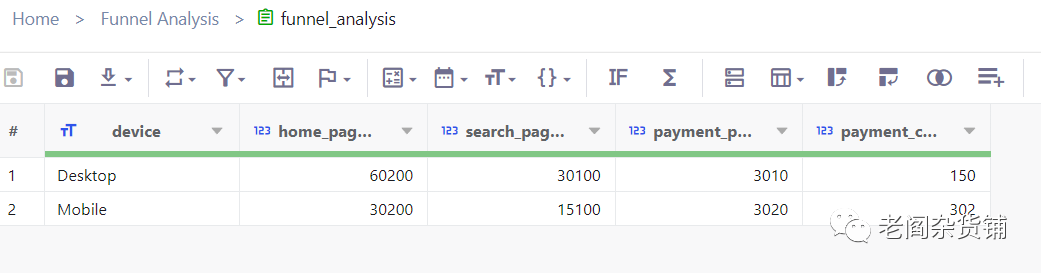

分组聚合后的结果如下:

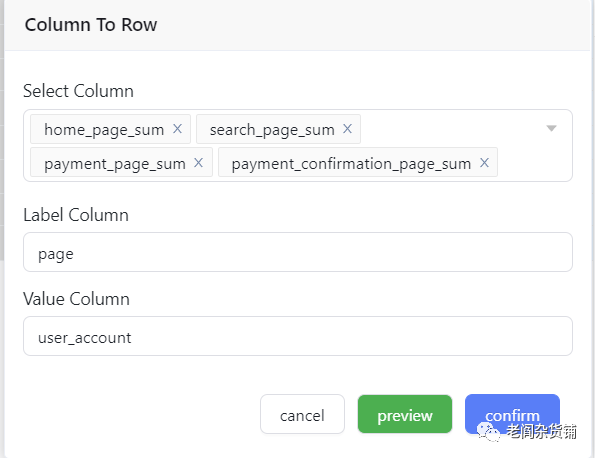

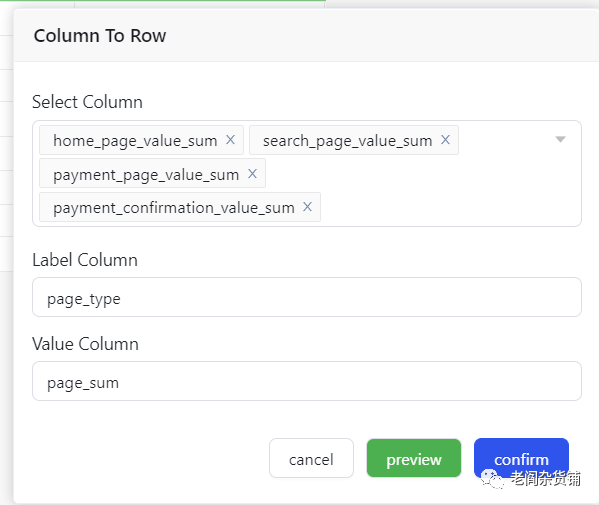

然后选择列转行操作:

最终生成的结果如下:

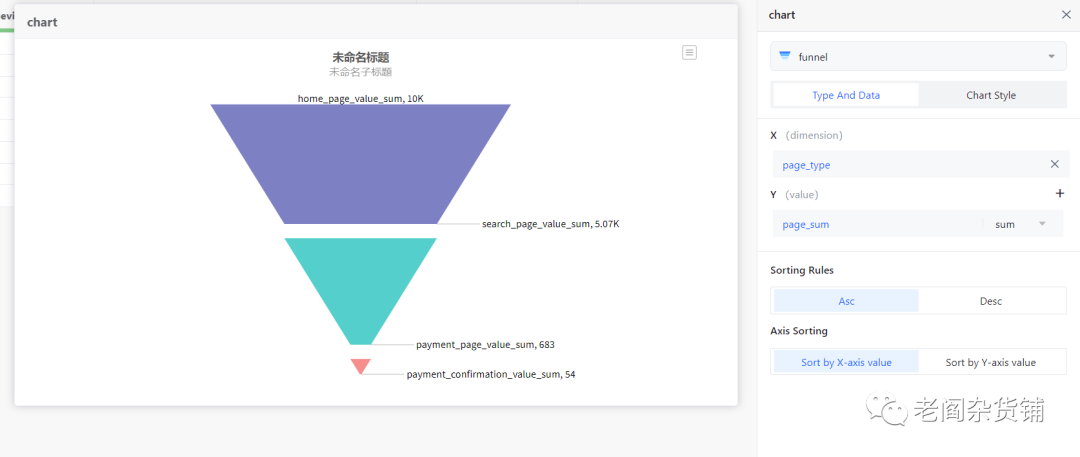

然后选择图表,我们选择漏斗图,则如下:

我们可以看到,从home page到search page的转化率为50.7%,而从search page到payment page的转化率则刚刚超过13%左右,从payment page到payment confirmation页面的转化率则不到8%。

06

趋势分析

我们以date,device,sex进行分组,计算每个页面的汇总配置如下:

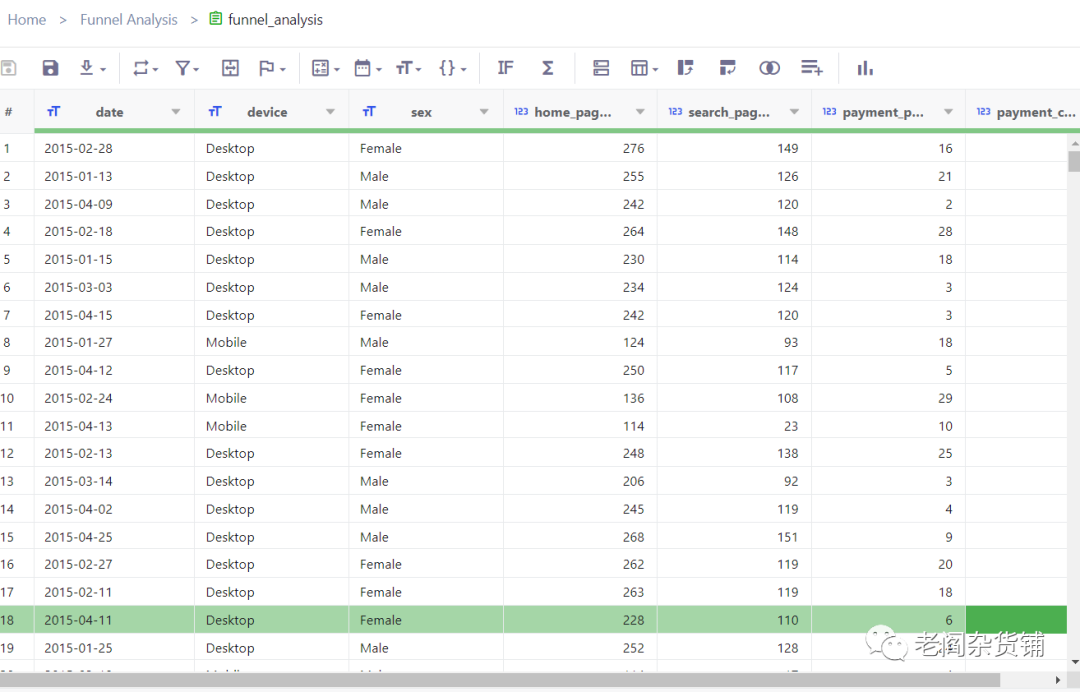

计算的结果如下:

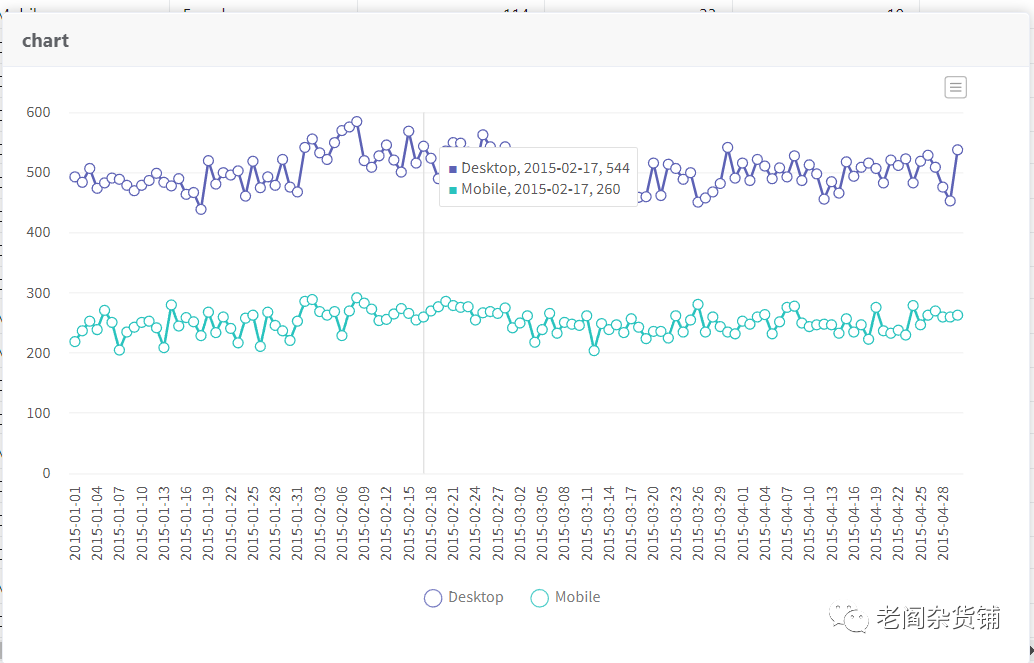

我们可以用图表来查看一下每天在不同页面的不同设备类型的数据,home page页面趋势如下:

可以看到每天Descktop大约是Mobile的两倍的访问量。然后再看search page的页面趋势如下:

我们可以看到两个问题,第一个问题是在3月1日这一天开始,Mobile类型的设备访问量大幅度降低,从每天200左右降低为50左右。另外一个问题,在search页面,3月1日之前,Desktop和Mobile的访问量差距远远到不了两倍。

从这个数据趋势,我们需要去分析两个问题:

1,为什么Desktop到search页面的转化率显著低于Mobile,这有可能是产品在设计的时候用户不容易在desktop找到搜索的入口。

2,为什么3月1日这一天Mobile类型到Search页面显著的降低,是否可能是Mobile端产品在这一天做了一些改变,造成了用户不容易找到Search页面。

我们还可以继续分析payment page, payment confirmation page的趋势和访问情况。

另外,我们也可以拆解性别来进行类似的数据趋势分析,看看是不是根据性别有什么趋势的不同。

07

总结

通过这一系列操作,我们可以看到,通过一个无代码的工具,我们可以非常方便的自助的去进行数据的各种处理动作。交互式地处理自己的数据,去构建转化漏斗,去进行趋势分析。在日常工作中,一个趁手的数据工具无疑可以使得我们更方便的从数据去找问题,从而提高我们应用数据的水平。在数字化驱动成为趋势的今天,好的数据工具是可以大大得提高使用数据的效率的。