一、Kafka-connector 在Flinkx 中的使用

1.Flinkx 框架ddl 如何映射到 Kafka-connector?

2.Flinkx Kafka-connector 基于Flink 原有对Connector 扩展-Source 部分

Metric 信息基于State保存

负载SubscriptionState 添加了对消费延迟信息对获取

脏数据对管控(包括脏数据指标的监控,脏数据信息的记录等)

3.Flinkx Kafka-connector 基于flink 原有对connector 扩展-Sink部分

Metric 信息基于State保存

自定义分区逻辑,用于将相同的key 放入同一个分区

二、kafka-connector 如何进行分片

1.Flink 是如何获取到Kafka 分区的, 和Batch 比如读取rdb 分片有什么区别?

2.Flink 的Subtask 是如何和对应的Kafka Partition 关联上的?

3.如果Kafka 分区发生变化, Flink 是如何感知到的呢?

三、如何实现Exactly Once

1.实现关键接口:CheckpointedFunction, CheckpointListener

2.Flink-Kafka-connecotr 如何实现的二阶段提交

更多技术交流方式

想面对面技术交流?想看技术大佬直播?扫码加入钉钉群“袋鼠云开源框架技术交流群”(群号:30537511)

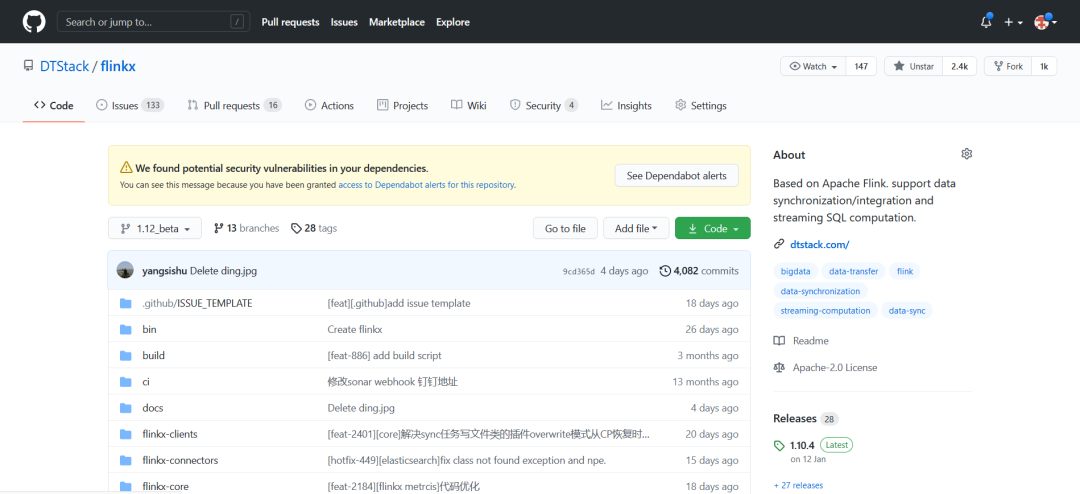

想体验更多数栈开源项目?在Github社区或Gitee社区搜索“FlinkX”开源项目

Github开源项目地址:

https://github.com/DTStack/flinkx

Gitee开源项目地址:

https://gitee.com/dtstack_dev_0/flinkx