目录

深度学习总结

AI的哲学理解

深度学习的理论基础

非线性近似

梯度下降优化

反向传播算法

前馈神经网络MLP

卷积神经网络CNN

循环神经网络RNN

对我个人的意义

对知识的好奇

各学科的整合

想法的借鉴

参考书籍

深度学习总结

摘要:随着建立在人工智能AI上的应用或者设备越来越频繁地出现在大众视野中,作为一名互联网技术从业者,越发对自己的技术在社会进步和发展中是否能有一席之地感到一种危机感,我相信只有紧跟技术前沿,才能在这个不断变化、发展的社会潮流中,打造出自己的一片天地,为这个社会贡献出自己的一份价值,这份价值除了满足我的社会需求(与社会共存),同时也满足了我的个人需求(对知识的好奇),以及自我价值的实现(我喜欢的东西给社会带来了价值)。基于以上种种,我又再次学习了AI之深度学。(本总结是一次阶段性的总结)

关键词:神经网络、深度学习、非线性、混沌、梯度下降

AI的哲学理解

当对“小爱同学”喊出一个个指令,对“嘿,Siri”说出一个个诉求,然后似乎都得到了很满意的回应,也许对这种应用和设备已经习以为常,但是如果继续深入思考下去,它似乎实际上是在表达一种世界观:世界是可预测的,不是不可预测的。甚至即使是随机的,但是如果可以被概率论(概率论是对经验事实的一种理论化描述,所谓的描述是说,不是概率论创造了事实,而是事实恰好可以被概率论描述)描述,也被我归类为可预测的一部分。而这种世界观也有其心理学基础:人倾向于追求可预测的、可控制的环境。换句话说,是人类刻意打造出了这么一个可预测的世界,而这就是AI可以出现和应用的本质原因。

深度学习的理论基础

即使世界是可预测的,但是对其的了解却不是那么一目了然。为了让总结变得更加实际,我把世界的范围缩小到数学领域。在数学中,我们学过很多曲线,直线,抛物线,双曲线等,还学过傅里叶变换、泰勒公式等,总之是越来越复杂,但是此处我把上述关系粗略的分为两类:线性和非线性。此处不纠结于两者的正式定义,仅对两者下一个直觉定义:线性就是人们熟悉的比例变化或者加法变化,例如直线,平面等;非线性就是存在凹凸不平的变化,例如随手画出的一条波浪曲线。即使承认世界是可预测的,但却大部分是非线性的,难以捉摸。

为了进一步理解非线性,让我们回顾几个现实生活中的例子:

(1)音乐的声波曲线;

(2)室内的温度变化;

(3)股票的价格起伏;

(4)大气的风云变换;

(5)心脏的跳动韵律;

这些例子提醒我们,面对非线性,也许只能做到切身感受,但是却不能做到精确的数学描述。不过幸运的是,伟大的先人科学家们用他们的智慧探索出了一个个非线性的理论。例如:

(1)实变函数与泛函分析:从阿拉伯数字到有理数,从有理数到实数,现在的习以为常却是曾经最大的阻碍。

(2)测度论:从黎曼积分到勒贝格积分,再到抽象积分,测度论给了答案。

(3)混沌理论:初见非线性,如黑暗遮蔽双眼,如雾模糊不堪,让传统故意视而不见,让智者挠头,似乎是理论的起源(个人的浅薄认识)

基于这些理论,人类逐渐征服非线性的高地,得以一探世界本质。

非线性近似

世界大部分是由非线性现象组成的,而非线性又是难于精确描述的,但是通过理论的指导,却是可以做到对非线性现象的模拟和近似,例如

(1)傅里叶变换

(2)算子的赋泛线性空间

(3)建立在测度论上的概率推断

虽然神经网络学习起源于神经科学,并试图模仿人脑的联结模式,这给了AI一个很直观的理解,但是若想驾驭非线性,仅凭联结这种表面的认识显然是远远不足的,还需要非常深刻的理论指导。犹如中国经济稳定发展的条件除了有14亿这个人口基数之外,更有背后中国共产党的领导一样。联结和理论是相辅相成的关系。

总之,通过联结和非线性理论,可以人为制造出近似「现实非线性」的深度学习神经网络。但是,却没有一个完善的理论揭示:该怎样通过联结和非线性理论近似「现实非线性」。而这又进一步使得我认为:AI不是一个理论,其仅仅是一个应用,它是建立在各个基础理论指导上的,只要没有对「现实非线性」有充分的认识,那么AI的发展和进步就不会增加人类的知识(此处是针对应用这个角度来表达观点的)。

梯度下降优化

上文提到,我们通过联结和非线性理论来近似「现实非线性」。在这个过程中,我们就会引入输入函数、非线性函数、输出函数、损失函数等概念,可是就如同y=ax+b这个简单的线性函数一样,一个具体的函数会包括两部分:函数结构+函数参数。函数结构是在近似中事先确定好的,例如线性函数,正切函数,卷积函数等等,而最终要确定的却是这些函数的参数,而这个参数的确定就是通过梯度下降算法得到(因为近似理论通常是一个最大值或最小值的极值问题)。梯度方向就是函数值下降最快的方向,直到这个方向是0,即表示函数值不再下降,此时也就找到了函数的极值点。

反向传播算法

例如函数y=f(x),z=g(y),求z对x的导数时,我们可以使用链式法则逐步求导,而不需要先把y换成f(x)代入g中,然后再对x求导,这种代入求导不适合机器运算。

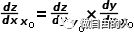

反向传播算法就是利用这种链式求导法则,把一个复杂的函数运算分解成各个独立的小函数,然后分别求导,一种由简到复杂的组合策略,即分治。链式求导法则的另一个关键是知道 和

和 的值才能计算出最终的表达式,因此反向传播算法必须依赖前向传播的计算存储

的值才能计算出最终的表达式,因此反向传播算法必须依赖前向传播的计算存储 和

和 的值。

的值。

前馈神经网络MLP

又名多层感知机,描述联结+非线性函数的神经网络形式,属于一种原型机神经网络,其中的层表示隐藏层,隐藏层或是非线性,或是线性的,但至少要有一层非线性层,否则就不需要神经网络这么复杂的东西了。

卷积神经网络CNN

存在一层卷积运算的神经网络,专门用于处理网格化数据,卷积运算的意义:一个新的输出是其附近输入的加权平均。类比于股票K线的EMA算法,区别在于股票EMA使用的是股价的时间序列数据,卷积使用的是横截面数据。通常用于图像处理等。

循环神经网络RNN

处理序列的神经网络,主要用于上下文相关的例如文本序列,音频序列等等。RNN的缺点是当序列过长时,会导致特征值激增或衰减,不利于特征学习。为了可以学习长序列特征,引入了LSTM和门控RNN模式,我个人的理解是它们也是一种加权平均的变化形式,通过降低遥远序列的权重,增加附近序列的权重,从而扩大学习序列长度。仍然可用股票K线的EMA算法做类比。

对我个人的意义

对知识的好奇

我很好奇深度学习为什么能够做到看似只有人才能做到的事情,但是如果用世界可预测以及联结和非线性理论近似「现实非线性」,那么大概解答了心中的疑惑。

各学科的整合

深度学习让基础理论再一次发挥基建的作用,曾经对数学的学习以及数学和现实之间的脱轨让人一度怀疑数学到底是什么,因为我始终坚信数学是自然和社会的数学,脱离了自然和社会,数学就什么也不是,但是多数教材和书籍对数学的描述都过于形式化,这是我不喜欢的,而深度学习,或者说AI建立了一条数学和现实之间的路径。当然,能发挥数学作用的还有金融经济学,这也是我非常热爱的一门学科,甚至可以说学习深度学习的目的之一就是可以能再深入研究金融和经济。

想法的借鉴

深度学习是通过联结和非线性理论近似「现实非线性」,那么为了让近似更加真实,也会督促人们对「现实非线性」有更加深刻的了解,而这个过程就是人们探索世界了解世界的过程,于是深度学习领域就会吸收新的想法或者理论。那么,与其说是学习深度学习,不如说是通过深度学习这么一个渠道,增加对现实的理解,我认为这是很有意义的。

参考书籍

1.深度学习 伊恩·古德费洛 人民邮电出版社

2.重温微积分 齐民友 高等教育出版社

3.实分析与泛函分析 匡继昌 高等教育出版社

4.信息论与编码(第3版)清华大学出版社